Deep fake’lerin daha belirgin bir saldırı vektörü haline gelmesi bekleniyor. Bunları nasıl tanımlayacağınız aşağıda açıklanmıştır.

Derin Sahte nedir?

Deep fake, bilgi manipülasyonu gerçekleştirmek için gerçek görüntüleri ve videoları kötü niyetli bir şekilde fabrikasyon olanlarla değiştirme eylemidir. Deep fake’lerde kullanılabilecek kadar yüksek kalitede görüntü, video ve ses oluşturmak için AI ve ML gereklidir. Yapay zeka, makine öğrenimi ve görüntü değiştirmenin bu tür kullanımı, bilgilerin yanlış sunulması, bilgilerin bazı bölümlerinin izole edilmesi veya aldatıcı bir şekilde düzenlenmesi gibi daha az aşırı manipülasyon teknikleri kullanan diğer bilgi işleme türlerinden farklıdır. Cato Networks Kıdemli Güvenlik Stratejisi Direktörü Etay Maor, “Karmaşıklık eklemek için, son gelişmeler ve GPT3 gibi yapay zeka tarafından oluşturulan metne erişilebilirlik, etkileşimli, insan görünümlü konuşma robotları”

Derin Sahteler Neye benziyor?

Derin sahte tüm şekil ve boyutlarda gelir. Bazıları daha basit ve bazıları daha gelişmiş. Deep fake’lerin en popüler örneklerinden bazıları şunlardır:

Yüz nakli

Yüz değiştirme, bir video veya görüntüdeki yüzü bir kişiden diğerine değiştirme eylemidir. Yüz değiştirme, özel bir yazılım gerektirir, ancak ileri teknolojiye dayalı olması gerekmez – bugün yüz değiştirmeyi destekleyen mobil uygulamalar bile bulunabilir. Mobil uygulamalarda bulunan yüz değiştirme, genellikle kullanıcının fotoğrafları ile film sahnelerindeki oyuncuların yüzleri arasında geçiş yapma gibi basit kullanım durumlarıyla sınırlıdır.

Daha gelişmiş yüz değiştirme mevcuttur, ancak daha fazla model eğitimi ve kod ve – sonuç olarak – pahalı ve kaynak yoğun olan GPU’lar gerektirir. Tom Cruise’un sunum yapan kişinin yüzüyle değiştirildiği bu videoda daha gelişmiş bir yüz takas derin sahte örneği görülebilir:

Bu Tom Cruise yüz takası, bir GPU üzerinde iki saatlik eğitimin yanı sıra günlerce profesyonel video düzenleme sonrası işleme gerektirdi. Bu çok gibi gelebilir, ancak aynı zamanda diğerlerinden daha basit bir takas olarak kabul edildi, çünkü sunum yapan kişi Cruise’a benzer bir saç kesimine sahipti ve sesini taklit edebiliyor, bu da daha az eğitim ve son işlem gerektiği anlamına geliyor.

Puppet Master (Dudak Senkronizasyonu)

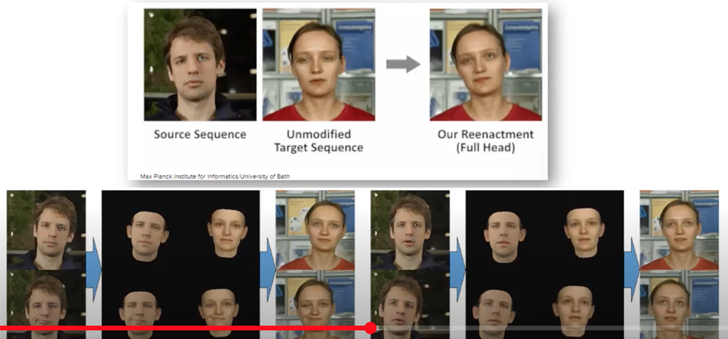

‘Puppet Master’ derin sahtekarlığı, bir kişinin ağız hareketlerinin görüntüsünün manipüle edildiği, kişinin aslında söylemediği bir şeyi söylüyormuş gibi göründüğü bir tekniktir. Bir modeli yeni, değiştirilen yüz üzerinde eğiten yüz değiştirme ile karşılaştırıldığında, ‘Puppet Master’ bir modeli orijinal görüntünün yüzünde ve özellikle ağız hareketlerinde eğitir.

İşte göründüğü gibi:

[warning – explicit language]

‘Puppet Master’ın arkasındaki teknoloji, maskenin, yani orijinal görüntünün sentezlenmesi ve onu taklit eden kişinin modelinin üzerine yerleştirilmesi ve dudak senkronizasyonu yapılmasına dayanmaktadır.

Ses

Derin sahtekarlığın üçüncü öne çıkan türü ses tabanlıdır. Audio deep fake’ler, gerçek bir kişinin sesini alan ve daha önce hiç söylemedikleri bir şeyi söylüyormuş gibi hissettiren ses dosyalarıdır. Ses derin sahteleri, ses dosyaları alınarak, seslere ek açıklamalar tahsis edilerek, sesleri metinle ilişkilendirmek için ek açıklamalara dayalı bir makine öğrenimi modeli eğitilerek ve ardından yeni bir ses dosyası oluşturularak oluşturulur.

İşte kulağa şöyle geliyor:

Derin Sahteler ve Ucuz Düzeltmeler

Tüm değiştirilmiş görüntüler veya sesler derin sahte değildir. Derin sahteler, yapay zeka kullanılarak sentezlenen veya değiştirilen medyayken, ucuz düzeltmeler, tespit edilmesi kolay, düşük teknolojili yöntemler kullanılarak sentezlenen veya değiştirilen medyadır. Genellikle çarpıtmalara sahiptirler ve açıkça manipüle edilmişlerdir. Ucuz bir düzeltme şöyle görünür:

Derin Sahtelerin Siber Riski

Deep fake’ler daha gerçekçi ve erişilebilir hale geldi ve ayrıca her zamankinden daha hızlı oluşturuluyor. Bu onları silahlandırma için güçlü bir araç yapar. Sonuç olarak, işletmeler ve ülkeler için risk oluşturuyorlar. Siber suç, sosyal mühendislik, dolandırıcılık, tehdit aktörü ülkeler tarafından yabancı operasyonları etkilemek ve daha fazlası için kullanılabilirler.

Örneğin, bir CEO’nun sesini taklit etmek ve bir yöneticiyi bir dolandırıcılık hesabına 243.000 dolar havale etmeye ikna etmek için derin sahte kullanıldı. Cato Networks’ten Etay Maor “İş e-postası kapsıyor ve kimlik avı saldırılarını tespit etmek, kullanılan dilin basit analizine dayalı olarak giderek zorlaşıyor. farklı çoklu tıkanma noktalarında saldırıyı tespit edebilir ve başarısız olmaya mahkum izole edilmiş nokta ürünlerine güvenmez”. Başka bir davada, bir çocuk velayeti davasında derin bir sahte delil olarak sunuldu.

Deep fake’ler dezenformasyon yaymak için kullanılabilir, yani kamuoyunu etkilemek veya gerçeği karartmak için yanlış bilgi dağıtımı. Örneğin, derin sahteler, dünya liderlerini taklit etmek ve bir saldırıyı ateşlemek veya bir CEO’yu taklit etmek ve bir şirketin hisse senedi fiyatını manipüle etmek için kullanılabilir. Diğer durumlarda, derin sahteler, insanların derin sahte olduklarını iddia ederek tüm medya kaynaklarını inkar edebilecekleri ve bu da sosyal bir güven ihlali yaratan makul inkar edilebilirliği mümkün kılar.

Son olarak, derin sahtekarlık karalama, yani birinin iyi itibarını zedeleme için kullanılabilir. Örneğin, intikam pornosu oluşturarak.

Derin Sahtekarlıklar Nasıl Tespit Edilir?

Derin sahteleri doğru bir şekilde tespit etmek için iki ana yöntem türü vardır:

- Düşük seviye algılama yöntemleri

- Üst düzey algılama yöntemleri

Düşük Seviye Tespit Yöntemleri

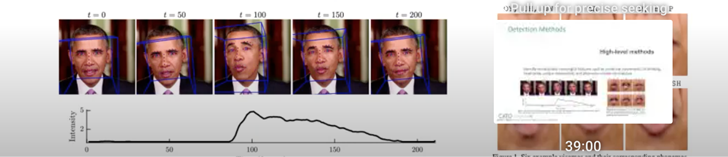

Düşük seviyeli algılama yöntemleri, derin sahte üretim süreci aracılığıyla tanıtılan yapıtları veya pikselleşmeleri tanımlamak için eğitilmiş makine öğrenimi modellerine dayanır. Bu eserler insan gözü tarafından algılanamayabilir, ancak gerçek görüntüler ve derin sahte görüntüler üzerinde eğitilmiş modeller bunları algılayabilir.

Üst Düzey Tespit Yöntemleri

Üst düzey algılama yöntemleri, anlamsal olarak anlamlı özellikleri tanımlayabilen modeller kullanır. Bunlar, göz kırpma, kafa duruşu veya benzersiz tavırlar gibi doğal olmayan hareketleri ve fonem-viseme uyumsuzluklarını içerir.

Bugün, bu tespit yöntemlerinin doğru olduğu kabul edilmektedir. Bununla birlikte, derin sahte teknoloji geliştikçe ve daha sofistike hale geldikçe, daha az etkili olmaları ve güncellenmeleri ve iyileştirilmeleri gerekecek. Bu tekniklere ek olarak, her birimiz aldığımız video ve görüntülerin medya kaynağını doğrulayarak derin sahtekarlıkları tespit etmeye yardımcı olabiliriz.

Farklı türde siber güvenlik saldırıları ve bunların nasıl önleneceği hakkında daha fazla bilgi edinmek için Cato Networks’ün Siber Güvenlik Masterclass serisini inceleyebilirsiniz.