Yapay Zeka ve Makine Öğrenimi, Yeni Nesil Teknolojiler ve Güvenli Geliştirme

Beyaz Saray, Savunma Bakanlığı ve DHS Liderleri, Ajanslarının Yapay Zekayı Nasıl Kullandığını Açıkladı

Michael Novinson (MichaelNovinson) •

14 Eylül 2023

Perşembe günü yapılan bir kongre panelinin duyuşuna göre ABD hükümeti, yapay zekanın, ulus devlet düşmanlarının daha tehlikeli hackleme girişimleri gibi teknolojinin olumsuz yönlerine hazırlanırken operasyonları nasıl geliştirebileceğini test ediyor.

Ayrıca bakınız: Web Semineri | SASE Dağıtımınız Neden ZTNA 2.0 ile Başlamalı?

Beyaz Saray’ın bilim ve teknoloji politikası ofisi direktörü Arati Prabhakar, “Siber güvenlik unsuru, yapay zeka teknolojisinin parlak ve karanlık tarafının harika bir örneğidir” dedi. “Tüm çalışmalarımızın odaklandığı seçimler şu: ‘Bu riskleri nasıl azaltırız ve siber güvenlik sistemlerimizi nasıl güvence altına alırız?'”

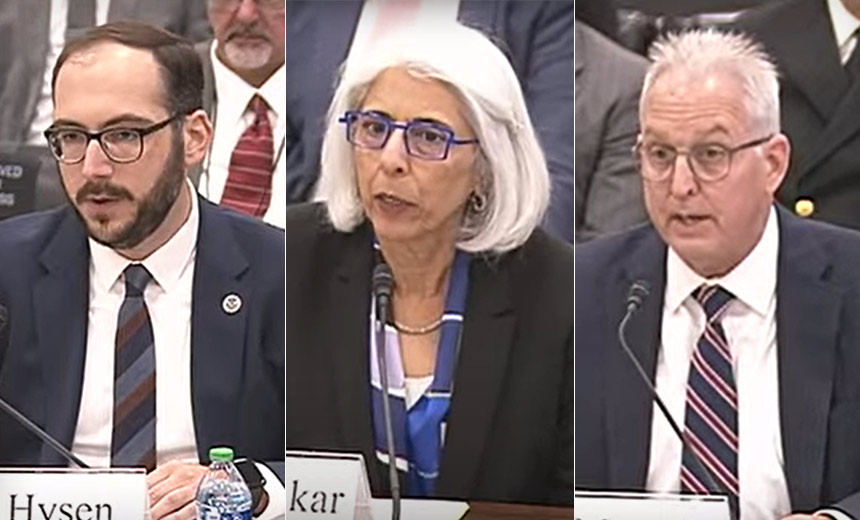

Prabhakar Perşembe günü, Federal kurumların yapay zekayı nasıl kullandıklarına odaklanan Temsilciler Meclisi duruşmasında İç Güvenlik CIO’su Eric Hysen ve Savunma Bakanlığı Dijital ve Yapay Zeka Sorumlusu Craig Martell ile birlikte ifade verdi.

Hysen milletvekillerine, İç Güvenlik Bakanı Alejandro Mayorkas’ın bir yapay zeka görev gücü kurduğunu ve yapay zekanın kritik altyapıyı güvence altına almak için nasıl kullanılabileceğini inceleyerek yönlendirdiğini söyledi. İç Güvenlik Bakanlığı, yapay zeka kullanımlarını korumak ve ortaya çıkan tehditlere karşı savunma sağlamak amacıyla siber güvenlik uygulamalarını güçlendirmek için kritik altyapı kuruluşlarıyla ortaklık kurmayı planlıyor.

Yazılı ifadesinde Hysen, bakanlığın bir bileşeni olan Siber Güvenlik ve Altyapı Güvenliği Ajansının, federal ağların savunmasında yazılım açıklarını daha iyi tespit etmek ve azaltmak için yapay zekadan yararlanmak için çalıştığını söyledi. CISA departmanın bir parçasıdır (bkz: Uzmanlar Kötü Amaçlı Kullanım ve Çin Etkisi Çevresindeki Yapay Zeka Risklerini Araştırıyor).

Martell, idari görevlerde çalışan insan sayısını azaltmak ve daha fazla askeri memurun temel güvenlik misyonuna odaklanmasını sağlamak için yapay zekanın kullanılmasında “muazzam bir potansiyel” gördüğünü söyledi. Savunma Bakanlığı subaylar için karar desteği olarak yapay zekayı kullansa da Martell, karar verme sorumluluğunun hala subaylarda olduğunu söyledi.

Yapay Zeka Sistemlerini Güvenli ve Etkili Hale Getirmede Hükümetin Rolü

Prabhakar, Ulusal Standartlar ve Teknoloji Enstitüsü’nün yapay zeka risk yönetimi çerçevesinin, hem kamu hem de özel sektör için güvenli ve etkili yapay zeka yaratmaya yönelik daha uzun bir yolculukta önemli bir adım olduğunu söyledi. Kendisi, çerçevenin, bir yapay zeka sisteminin nasıl güvenli ve etkili hale getirileceği konusunda hangi soruların sorulması gerektiğini bulma konusunda hükümet ve sektör yetkililerini doğru yöne yönlendirdiğini söyledi.

Bilim ve Teknoloji Politikası Ofisi, Ekim ayında bir yapay zeka sistemi için en temel değerlere odaklanan bir yapay zeka haklar bildirgesi taslağını yayınladı. Özellikle insanlara karşı ayrımcılık yapmaması ve sistemin kendisinin güvenli ve emniyetli olması. Prabhakar, kuruluşların yapay zeka sistemleriyle ilişkili riskleri yönetmek için uygulamaya konulması gereken süreçlerle uğraşması gerektiğini söyledi.

Prabhakar, ileriye dönük olarak NIST’in, fiziksel ürünlerin güvenliğini değerlendirmek için kullanılan süreçlere benzer şekilde, yetkililerin bir AI sisteminin güvenli ve etkili olup olmadığını belirlemelerine yardımcı olacak araçlar ve yöntemler geliştirmek için teknoloji topluluğuyla birlikte çalışması gerektiğini söyledi. Ancak Prabhakar, çalışmaların hala yapılması gerektiğini söyledi.

Prabhakar, “İhtiyacımız olan şey, yapay zeka sistemlerinin güvenli ve etkili olduğu, yapmalarını istediğiniz şeyleri yaptıkları ve tehlikeli ya da yapmalarını istemediğimiz uygunsuz şeyleri yapmadıkları bir gelecek.” dedi. “Fakat şirketlerin, araştırmacıların, hiç kimsenin aslında bunun nasıl yapılacağını tam olarak bilmediği konusunda hepimiz çok açık olmalıyız.”