Yapay Zeka ve Makine Öğrenimi , Siber Savaş / Ulus Devlet Saldırıları , Dolandırıcılık Yönetimi ve Siber Suçlar

‘Kör İnanç’ Mimarileri Askeri Cephaneliğe Yayılıyor

Micheal Novinson (Michael Novinson) •

19 Nisan 2023

Milletvekilleri bugün, yapay zekanın savaşçıları dijital saldırılardan koruma çabalarına aynı anda hem yardımcı hem de zarar verebileceğine adanmış bir panelde, sıfır güven mimarisi olmadan geliştirilen ABD silah cephaneliğinin siber saldırılara karşı artan risk altında olduğunu duydu.

Ayrıca bakınız: Ateşkes! Çeviklik ve Güvenlik, Bulut Güvenliğinde “Birlikte Daha İyi” Çalışan Ortaklık Buluyor

Silah sistemleri, bir uçaktaki kontrol yüzeylerinden, denizaltılardaki veri radyolarına kadar dijital işlevleri yerine getiren onlarca, hatta yüzlerce özel amaçlı bilgisayar içerir. Savunma Bilimi Kurulu, on yıl önce, ordunun neredeyse akla gelebilecek her bileşeninin ağa bağlı olduğunu söyledi.

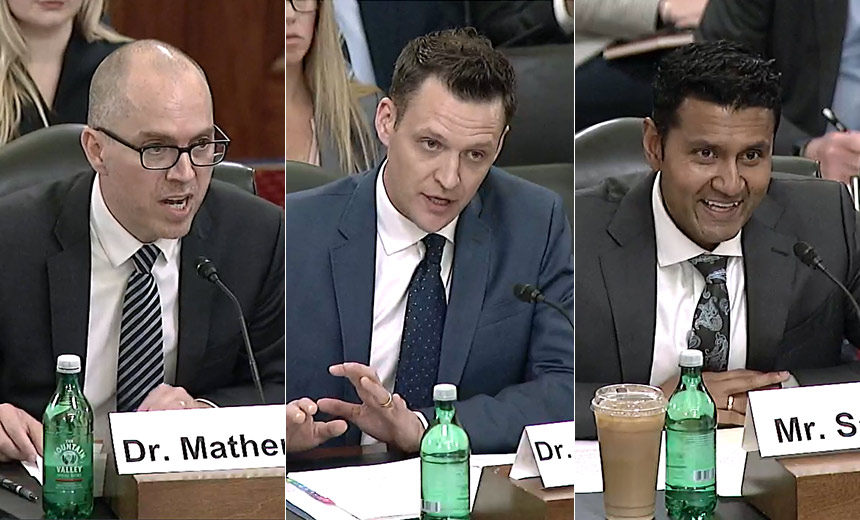

Palantir’in baş teknoloji yetkilisi Shyam Sankar Çarşamba günü Senato Silahlı Hizmetler alt komitesi önünde yaptığı ifadede, Hükümet Sorumluluk Bürosu’nun 2018’de Pentagon’un halihazırda inşa edilmiş silah sistemlerinde yaygın güvenlik açıklarına ilişkin artan kanıtları ele almaya yeterince hazır olmadığı sonucuna varmasından bu yana çok az şeyin değiştiğini söyledi. Sankar, “Sıfır güven mimarileri ile inşa edilen modern BT sistemlerinin aksine, bu silah sistemleri kör inanç mimarileri ile inşa edildi.” Dedi.

Savunma yetkilileri, yeni silah sistemlerine siber güvenlik inşa etmede ilerleme kaydetti, ancak finansman ve yönlendirme eksikliği, eski sistemler için “endişe verici derecede az ilerleme” ile sonuçlandı.

Panel, yabancı düşmanların yapay zekayı saldırgan siber silahların gelişimini hızlandırmak için kullanacağını duydu, ancak Shankar, yapay zekanın anormallikleri tespit etmek ve eski sistemlere izinsiz girişleri önlemek için de kullanılabileceğini söyledi. Bir karmaşıklık, eski silah sistemleri tarafından üretilen verilerin büyük çoğunluğunun etere dönüşmesi ve silah sistemlerinden en basit veri akışlarını bile çıkarmanın bir mücadele olduğunu söyledi.

Sankar, “Askeri bir çatışmada kazanacaksak, DOD’un silah sistemlerinin bir savaş ortamında ürettiği verilere sahip olması gerekiyor.” Dedi. “Buna gerçekten dikkat etmemiz gerekiyor.”

Rand Corp. CEO’su Jason Matheny, yapay zekanın saldırı silahları geliştirmede yeni ortaya çıkan merkezi konumunun, ABD’nin düşmanların kendi modellerini geliştirememesini sağlamak için cesur adımlar atması gerektiği anlamına geldiğini söyledi.

Matheny, “Bu AI modelleri şu anda çok kırılgan,” dedi. “Düşman saldırıları, veri zehirlenmesi ve model tersine çevirme gibi şeyler yaparak başka yerlerdeki ilerlemeyi yavaşlatabileceğimiz yolları düşünmemiz gerekiyor. Bize karşı kullanıldığını gördüğümüz hileleri kullanalım ve durumu anladığımızdan emin olalım. sanat.”

Shift5’in kurucu ortağı ve CEO’su Josh Lospinoso, saldırganların ortaya çıkan algoritmaları bozmak için yapay zeka modellerini eğitmek için kullanılan verileri değiştirdiği veri zehirlenmesinin ABD için zaten bir risk olduğunu söyledi. Bunlar gerçek problemler dedi. “Bunları geniş çapta dağıtmadan önce yapay zeka algoritmalarımızdaki güvenlik açıklarını desteklemeyi net bir şekilde düşünmeliyiz ve ardından pisliği temizlememiz gerekiyor.”

Matheny, gelişmiş yapay zeka sistemlerinin yanlış ellere geçmesi durumunda etkiyi azaltabilecek birkaç önlem önerdi. Uzaktan azaltılabilen çiplerin zararsız kullanımlarını lisanslarken, önde gelen yapay zeka çipleri üzerinde güçlü ihracat kontrolleri yürürlüğe koyma çağrısında bulundu. Şirketlerin, büyük bilgi işlem kümelerinin veya eğitimli yapay zeka modellerinin gelişimini ve dağıtımını kaydetmesi gerektiğini söyledi.

Matheny, yetkililerin, kötü aktörler tarafından kötüye kullanımı önlemek için, kullanılan bilgi işlem miktarını ve açık kaynak bileşenlerine bağlılığı kaydeden yapay zeka modelleri etrafında bir lisanslama rejimi veya yönetişim sistemleri oluşturması gerektiğini söyledi. İstihbarat topluluğu, yapay zeka yatırımları, yetenekleri, malzemeleri ve yetenekleri söz konusu olduğunda, yabancı düşmanların ne yaptığına ilişkin toplama çabalarını da genişletmelidir.

Matheny, “Hükümetin, ‘Belirli bir kapasite düzeyine sahip, belirli bir boyutun üzerindeki araçlar, rakiplerimiz de dahil olmak üzere, dünya çapında özgürce paylaşılamaz’ demesine izin veren bir düzenleyici yaklaşıma ihtiyacımız olacak.” dedi. “Dağıtılmadan önce belirli güvenlik garantilerine sahip olmamız gerekiyor.”

Son olarak Matheny, ABD hükümetinin, güvenlik önlemleri olmadan büyük AI modellerinin geliştirilmesini engellemek için AI çiplerine gömülü mikroelektronik kontroller de dahil olmak üzere AI güvenlik “moonshots” peşinde olduğunu görmek istediğini söyledi. Ayrıca Matheny, yasa koyucuların yapay zeka sistemlerinin devreye alınmadan önce güvenlik ve emniyetini değerlendirmek için genelleştirilebilir bir yaklaşım geliştirmelerini umuyor.

Matheny, “Gördüğüm tehditlerden biri, Amerika Birleşik Devletleri’nde zararsız kullanım için geliştirdiğimiz teknolojinin başkaları tarafından çalınıp kötüye kullanılabilmesidir” dedi. “Bunu önlememiz gerekiyor.”