Hiç kimseyi şaşırtmayacak bir şekilde, sosyal medya verilerinin Yapay Zeka (YZ) eğitmek için kullanılmasıyla ilgili bir şikayet daha ortaya çıktı.

Bu seferki şikayet X’e (eski adıyla Twitter) ve Elon Musk’ın şirketi xAI tarafından geliştirilen konuşma AI sohbet robotu Grok’a yönelik. Grok, metin üretebilen ve kullanıcılarla sohbetlere girebilen büyük dil modeli (LLM) sohbet robotudur.

Diğer sohbet robotlarından farklı olarak Grok, X aracılığıyla gerçek zamanlı olarak bilgilere erişme ve diğer AI sistemleri tarafından genellikle reddedilecek bazı soru türlerine yanıt verme yeteneğine sahiptir. Grok, Premium veya Premium+ aboneliği olan X kullanıcıları için mevcuttur.

Avrupa gizlilik grubu NYOB’ye (Sizi İlgilendirmez) göre:

“X, AB/AEA’daki 60 milyondan fazla kullanıcının kişisel verilerini, onların izni olmadan kendi yapay zeka teknolojilerini (örneğin “Grok”) eğitmek için hukuka aykırı bir şekilde kullanmaya başladı.”

NOYB, X platformu Avrupa kullanıcılarının kişisel verilerinin işlenmesiyle ilgili endişeler nedeniyle İrlanda Veri Koruma Komisyonu’nun (DPC) Twitter International Unlimited Company’ye karşı açtığı Yüksek Mahkeme davasını takip etmeye karar verdi; söz konusu davaların sonucundan memnun olmadığını belirtti.

Dublin merkezli Twitter International Unlimited Company, X’e ait tüm kişisel veriler açısından AB’de veri denetleyicisidir.

DPC, Twitter International’ın Grok’u kullanarak, bilgi gizliliği ve veri korumasına ilişkin yönergeleri belirleyen AB düzenlemesi olan GDPR kapsamındaki yükümlülüklerine uymadığını iddia etti.

Azaltma önlemlerinin uygulanmasına rağmen -sonradan- DPC, X’in milyonlarca Avrupa merkezli kullanıcısının çok önemli bir kısmının verilerinin bu azaltma önlemlerinin koruması olmaksızın işlendiğini ve işlenmeye devam ettiğini söylüyor; bu da GDPR kapsamındaki haklarla tutarlı değil.

Ancak NOYB, DPC’nin hedefi ıskaladığını söylüyor:

“Mahkeme belgeleri kamuya açık değil, ancak sözlü duruşmadan DPC’nin bu işlemin yasallığını sorgulamadığını anlıyoruz. DPC’nin sözde ‘hafifletme önlemleri’ ve Twitter’ın iş birliği eksikliğiyle ilgilendiği anlaşılıyor. DPC kenarlarda işlem yapıyor gibi görünüyor, ancak temel sorundan kaçınıyor.”

Bu nedenle NOYB, şu ana kadar dokuz ülkedeki (Avusturya, Belçika, Fransa, Yunanistan, İrlanda, İtalya, Hollanda, Polonya ve İspanya) veri koruma otoritelerine GDPR şikayetlerinde bulundu.

Yapmaları gereken tek şey sormaktı

AB’nin GDPR’si, kişisel verileri yapay zeka geliştirme ve eğitimi için kullanmak isteyen şirketler için kolay bir çözüm sunar: Kullanıcılardan sadece açık bir şekilde onay isteyin. Ancak X, izin istemeden verileri aldı ve daha sonra azaltma önlemleri olarak adlandırılan bir devre dışı bırakma seçeneği oluşturdu.

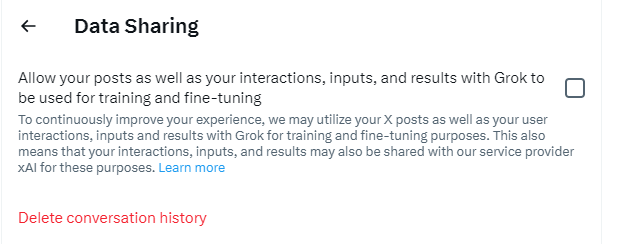

Grok eğitiminin başlamasından iki ay sonrasına kadar kullanıcılar X’in herkes için şirkete Grok’u eğitmek için verilerini kullanma hakkı veren varsayılan bir ayarı etkinleştirdiğini fark etmedi. Verilerinizi paylaşıp paylaşmadığınızı kontrol etmenin en kolay yolu, X’te oturum açmışken https://x.com/settings/grok_settings adresini ziyaret etmektir. Bir onay işareti varsa, verilerinizi Grok’un eğitimi için paylaşıyorsunuz demektir. Bu onay işaretini kaldırın ve durur.

Kişisel verilerin hedefli reklamcılık için kullanımıyla ilgili benzer bir davada Meta, kullanıcıların temel haklarından daha üstün olan meşru bir çıkarı olduğunu savundu. Bu, GDPR düzenlemelerinden kaçınmak için olası altı yasal gerekçeden biri olarak sayılır, ancak Adalet Divanı bu gerekçeyi reddetti.

Birçok AI sistemi sağlayıcısı, özellikle çoğu AI sisteminin uymayı başaramadığı “unutulma hakkını” şart koşan düzenleme olan GDPR ile ilgili sorunlarla karşılaştı. Bence bu, bu verileri ilk etapta AI sistemlerine dahil etmemek için iyi bir neden.

Benzer şekilde, bu şirketler her zaman eğitim verilerinde bulunan kişisel verilerin bir kopyasını veya bu verilerin kaynaklarını alma taleplerine cevap vermenin imkansız olduğunu iddia ederler. Ayrıca yanlış kişisel verileri düzeltme yeteneklerinin olmadığını da iddia ederler. Tüm bu endişeler, kişisel verilerin yapay zeka sistemlerine sınırsız bir şekilde alınması söz konusu olduğunda birçok soruyu gündeme getirir.

AB, yapay zekayı (AI) bu yenilikçi teknolojinin geliştirilmesi ve kullanımı için daha iyi koşullar sağlamak amacıyla düzenlemeyi amaçlayan AB Yapay Zeka Yasası’nı (“AI Yasası”) kabul ettiğinde, bu hususlardan bazıları rol oynadı. Örneğin Madde 2(7)), AI sisteminin tüm yaşam döngüsü boyunca gizlilik ve kişisel verilerin korunması hakkının garanti altına alınmasını talep eder.

Sadece tehditleri rapor etmiyoruz; sosyal medyanızı korumanıza yardımcı oluyoruz

Siber güvenlik riskleri asla bir manşetin ötesine yayılmamalıdır. Malwarebytes tarafından desteklenen Cyrus’u kullanarak sosyal medya hesaplarınızı koruyun.