Yapay Zeka ve Makine Öğrenimi, Yeni Nesil Teknolojiler ve Güvenli Geliştirme, Video

Yeni Uyumluluk Aracı, Birçok Yapay Zeka Firmasının Güvenlik ve Adillik Standartlarını Karşılayamadığını Söyledi

Akşaya Asokan (asokan_akshaya) •

30 Ekim 2024

Yeni açık kaynaklı yapay zeka geliştiricileri, Meta ve Mistral AI tarafından geliştirilen büyük dil modellerinin, 1 Ağustos’ta yürürlüğe giren Avrupa Birliği Yapay Zeka Yasası’nın siber güvenlik ve adalet gerekliliklerini karşılayamayan bir düzine yapay zeka modeli arasında yer aldığını söyledi. değerlendirme aracı.

Ayrıca bakınız: Güvenliğin Geleceği Neden Kimliktir?

COMPL-AI aracı, yapay zeka modellerinin AB Yapay Zeka Yasasına uygun olup olmadığını belirlemek için “hedef ele geçirme ve anında sızıntı”, “toksisite ve önyargı” gibi 27 değerlendirme kriterini kullanan bir çerçeve üzerine inşa edilmiştir. Test edilen yapay zeka modelleri arasında OpenAI’nin GPT-4 Turbo ve Claude 3 Opus gibi kapalı kaynaklı sistemlerinin yanı sıra Llama 2-7B Chat ve Mistral-7B Instruct açık kaynaklı modeller de yer aldı.

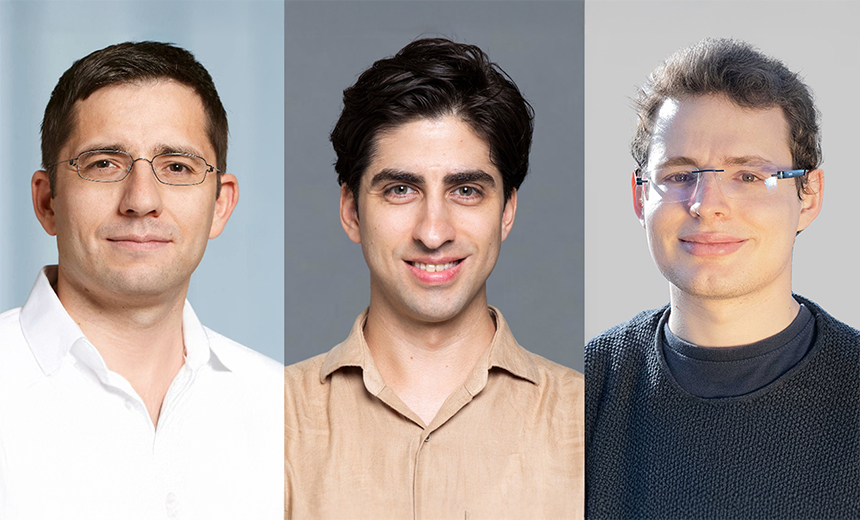

ETH Zürih bilgisayar bilimleri öğretim üyeleri Martin Vechev ve Zürih merkezli yazılım geliştiricisi LatticeFlow’un CEO’su Robin Staab, Petar Tsankov ve Bulgaristan’daki Bilgisayar Bilimi, Yapay Zeka ve Teknoloji Enstitüsü tarafından geliştirilen COMPL-AI, modellerin performans gösterdiği sırada şunu buldu: Siber güvenlik açısından zayıf olan ve “ayrımcılığın yokluğunu sağlayan” yapay zeka uygulamaları, zararlı ve toksik içerikleri önleme ve tanımlama konusunda iyi performans gösterdi.

LatticeFlow’un kurucu ortağı ve üniversite profesörü Vechev, “Yapay zeka modelleri, siber saldırı direnci konusunda çeşitli puanlar gösteriyor; çoğu puan %50’nin altında” dedi. “Anthropic ve OpenAI, modellerini jailbreak’lere ve hızlı enjeksiyonlara karşı başarılı bir şekilde uyarlarken, Mistral gibi açık kaynak sağlayıcıları buna daha az önem vererek, daha küçük modelleri daha büyük modellere kıyasla belirgin şekilde daha az dayanıklı hale getirdi.”

Bilgi Güvenliği Medya Grubu ile yapılan bu video röportajında Vechev, Staab ve Tsankov ayrıca şunları tartıştı:

- Test edilen yapay zeka modelleri AB Yapay Zeka Yasası siber güvenlik gereksinimlerini karşılamakta nasıl başarısız oluyor;

- Yapay zeka yönetişiminin makine öğrenimi operasyonları üzerindeki etkisi;

- Önümüzdeki beş yıl boyunca AB’deki yapay zeka pazarı eğilimleri.

Vechev, ETH Zürih Üniversitesi Bilgisayar Bilimleri Bölümü’nde bilgisayar bilimcisi profesörü ve LatticFlow’un kurucu ortağıdır. Odaklandığı alanlar arasında programlama dilleri, makine öğrenimi ve bilgisayar güvenliği yer almaktadır.

LatticFlow’un kurucu ortağı ve CEO’su Stankov, aynı zamanda ETH Zürih’teki Güvenli, Güvenilir ve Akıllı Sistemler Laboratuvarı’nda kıdemli araştırmacı ve öğretim görevlisi olarak görev yapıyor.

Staab, ETH Zürih’te bilgisayar bilimcisi ve doktora öğrencisidir.