Microsoft Pazartesi günü yaptığı açıklamada, 38 terabaytlık özel verinin açığa çıkmasına neden olan göze çarpan bir güvenlik gafını düzeltmek için adımlar attığını söyledi.

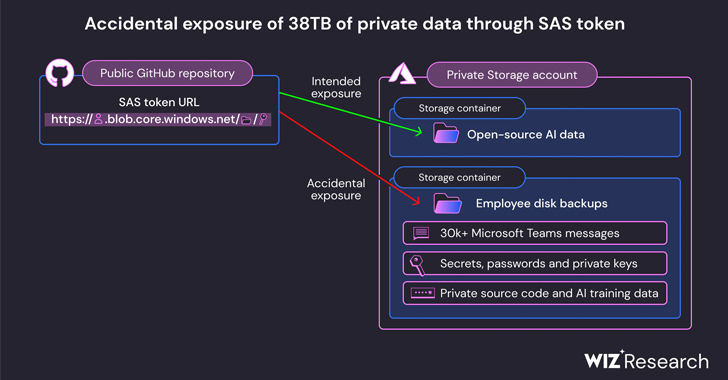

Wiz, sızıntının şirketin AI GitHub deposunda keşfedildiğini ve bir dizi açık kaynak eğitim verisi yayınlanırken yanlışlıkla kamuya açıklandığının söylendiğini söyledi. Ayrıca iki eski çalışanın iş istasyonunun sırları, anahtarlarını, parolalarını ve 30.000’den fazla dahili Teams mesajını içeren bir disk yedeğini de içeriyordu.

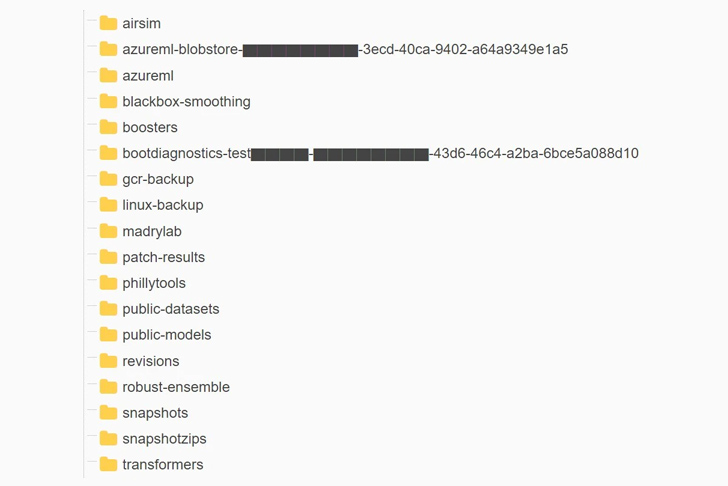

“Robust-models-transfer” adlı depoya artık erişilemiyor. Yayından kaldırılmadan önce, 2020 tarihli “Rakip Olarak Sağlam ImageNet Modelleri Daha İyi Transfer Ediyor mu?” başlıklı 2020 araştırma makalesine ilişkin kaynak kodu ve makine öğrenimi modellerine yer veriyordu.

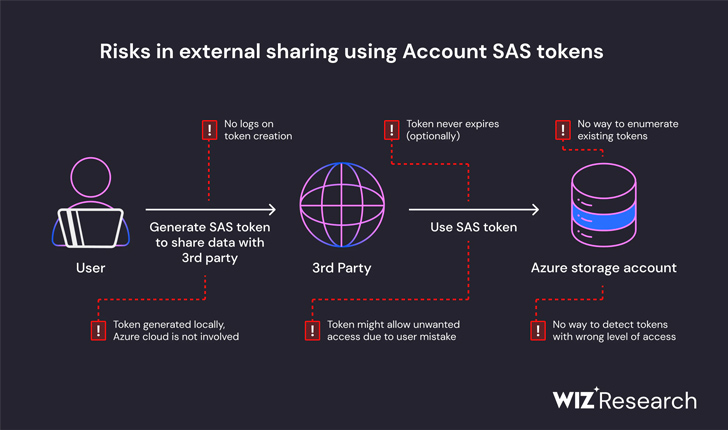

Wiz, bir raporda şunları söyledi: “Bu açığa çıkma, kullanıcıların verileri hem takip edilmesi hem de iptal edilmesi zor bir şekilde paylaşmasına olanak tanıyan bir Azure özelliği olan aşırı hoşgörülü bir SAS tokenının sonucu olarak ortaya çıktı.” Sorun 22 Haziran 2023’te Microsoft’a bildirildi.

Spesifik olarak, deponun README.md dosyası, geliştiricilere modelleri, yanlışlıkla tüm depolama hesabına erişim izni veren ve böylece ek özel verileri açığa çıkaran bir Azure Depolama URL’sinden indirmeleri talimatını verdi.

Wiz araştırmacıları Hillai Ben-Sasson ve Ronny Greenberg, “Aşırı izin veren erişim kapsamına ek olarak, token salt okunur yerine “tam kontrol” izinlerine izin verecek şekilde yanlış yapılandırıldı.” dedi. “Yani, bir saldırgan yalnızca depolama hesabındaki tüm dosyaları görüntülemekle kalmaz, aynı zamanda mevcut dosyaları da silebilir ve üzerine yazabilir.”

Bulgulara yanıt olarak Microsoft, soruşturmasında müşteri verilerinin izinsiz olarak ifşa edildiğine dair hiçbir kanıt bulamadığını ve “bu sorun nedeniyle başka hiçbir dahili hizmetin riske atılmadığını” söyledi. Ayrıca müşterilerin kendi taraflarında herhangi bir işlem yapmasına gerek olmadığı da vurgulandı.

Windows yapımcıları ayrıca SAS belirtecinin iptal edildiğini ve depolama hesabına tüm harici erişimin engellendiğini belirtti. Sorumlu açıklamanın ardından sorun iki kez çözüldü.

İleriye dönük bu tür riskleri azaltmak için şirket, gizli tarama hizmetini, aşırı izin verilen son kullanma tarihlerine veya ayrıcalıklara sahip olabilecek tüm SAS tokenlerini içerecek şekilde genişletti. Ayrıca tarama sisteminde, depodaki belirli SAS URL’sini yanlış pozitif olarak işaretleyen bir hata tespit ettiğini söyledi.

Araştırmacılar, “Hesap SAS tokenleri üzerinde güvenlik ve yönetim eksikliği nedeniyle bunların hesap anahtarının kendisi kadar hassas olduğu düşünülmelidir” dedi. “Bu nedenle, harici paylaşım için Hesap SAS’ı kullanmaktan kaçınmanız önemle tavsiye edilir. Token oluşturma hataları kolayca fark edilmeyebilir ve hassas verileri açığa çıkarabilir.”

Kimlik Yeni Uç Noktadır: Modern Çağda SaaS Güvenliğinde Uzmanlaşmak

Adaptive Shield CEO’su Maor Bin ile SaaS güvenliğinin geleceğine derinlemesine dalın. Kimliğin neden yeni uç nokta olduğunu keşfedin. Hemen yerinizi ayırtın.

Becerilerinizi Güçlendirin

Bu, yanlış yapılandırılmış Azure depolama hesaplarının ilk kez gün yüzüne çıkması değil. Temmuz 2022’de JUMPSEC Labs, bir tehdit aktörünün kurumsal bir şirket içi ortama erişim sağlamak için bu tür hesaplardan yararlanabileceği bir senaryoyu vurguladı.

Bu gelişme, Microsoft’un en son güvenlik gafıdır ve şirketin, Çin merkezli bilgisayar korsanlarının şirketin sistemlerine sızabildiklerini ve bir mühendisin kurumsal hesabını ele geçirerek ve muhtemelen bir çökme dökümüne erişerek son derece hassas bir imzalama anahtarını çalabildiklerini açıklamasından yaklaşık iki hafta sonra gerçekleşti. Tüketici imzalama sistemi.

Wiz CTO’su ve kurucu ortağı Ami Luttwak şunları söyledi: “Yapay zeka, teknoloji şirketleri için büyük bir potansiyelin kilidini açıyor. Ancak veri bilimcileri ve mühendisler, üretime yeni yapay zeka çözümleri getirmek için yarıştıkça, işledikleri büyük miktardaki veri, ek güvenlik kontrolleri ve önlemleri gerektiriyor.” Bir deyim.

“Gelişmekte olan bu teknoloji, üzerinde eğitim verilecek büyük veri kümeleri gerektiriyor. Birçok geliştirme ekibinin büyük miktarda veriyi işlemesi, bunu meslektaşlarıyla paylaşması veya kamuya açık açık kaynak projelerde işbirliği yapması gerektiğinden, Microsoft’unki gibi vakaları izlemek ve bunlardan kaçınmak giderek zorlaşıyor. “