Yazan: Jason Rebholz, Bilgi Güvenliği Baş Sorumlusu, Corvus Sigorta

Kuruluşlar, diğer kullanımların yanı sıra süreçleri hızlandırmak, verimlilik kazanmak, tekrarlayan, düşük değerli görevleri ortadan kaldırmak ve bilgiyi geliştirmek için üretken yapay zeka (GenAI) ve büyük dil modeli (LLM) teknolojilerini birleştirmenin sayısız yolunu buluyor. Kuruluşlar operasyonlarında verimlilik ararken, daha hızlı, daha karmaşık saldırıları, kimlik avı dolandırıcılıklarını ve kötü amaçlı yazılım dağıtımlarını mümkün kılmak isteyen siber suçlular da aynısını yapıyor.

GenAI ve LLM’nin hızlı gelişimi, siber suçluların saldırılarında bu teknolojilerden yararlanma konusundaki mevcut ve gelecekteki yetenekleri konusunda korku ve belirsizlik yarattı. Ancak endişeler şu anda gerçekçi olmayan seviyelere yükselmiş olsa da kuruluşların yakın vadeli ve gelecekteki tehditleri azaltmak için doğru güvenlik savunmalarına sahip olması zorunludur.

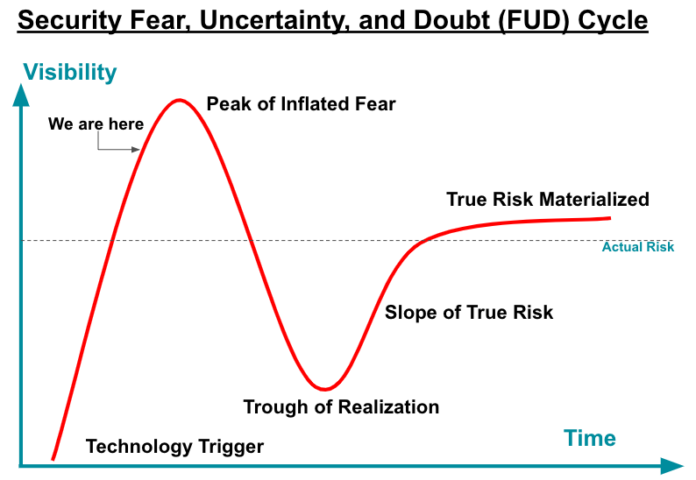

Güvenlik ve Korku, Belirsizlik ve Şüphe Döngüsü

Güvenlik endüstrisi, piyasaya sürülen her yeni hacker aracı veya yeteneğiyle birlikte bir korku, belirsizlik ve şüphe (FUD) döngüsünü takip etme eğilimindedir. Bu korkular genellikle ilk başta hayal gücü gerçeği aştığında abartılır. Keşiflerle ilgili gerçek risk seviyelerinin gerçekleşmesi genellikle zaman alır.

Bu GenAI ve LLM tabanlı bilgisayar korsanlığı araçlarının ilerlemesi söz konusu olduğunda şişirilmiş korku ve yanlış bilginin zirvesine yakınız. Hiç kimse sektörün (ve bilgisayar korsanlarının) bu döngüden ne kadar hızlı geçeceğini tahmin edemezken, gerçek riskin gerçekleşmesi ve bilgisayar korsanlarının saldırılarında araç yeteneklerini geniş çapta ve başarılı bir şekilde kullanmaya başlaması için biraz zaman vardır. Bu, savunuculara tehdidi doğru şekilde değerlendirmeleri ve en etkili savunmaları uygulamaları için zaman bırakır.

Kötü Amaçlı GenAI Araçlarının Mevcut Durumu

GenAI’nin bilgisayar korsanlığı araç kitlerine yönelik yakın vadeli uygulamalarının, siber saldırıların sıklığı ve ciddiyeti üzerinde önemli bir etkisi olmayacak. Etraflarındaki heyecana rağmen, WormGPT, FraudGPT, DarkGPT ve DarkBARD gibi bilgisayar korsanlığıyla ilgili popüler GenAI araçları sınırlı bir başarı elde etti ve çoğu zaten çöktü.

Kötü amaçlı GenAI araçları şu anda hem kullanılabilirlik hem de işlevsellik açısından sınırlıdır. Mevcut araçlar, ChatGPT benzeri teknolojilere dayanıyor ve sınırlı bir veri kümesi üzerinde eğitiliyor; bilgisayar korsanlığı teknikleri için temel bir bilgi deposu görevi görüyor ve bir saldırının belirli mikro görevlerini otomatikleştirmek için kullanışlıdır.

- Sosyal mühendislik taktiklerini kolaylaştırın – Kimlik avı e-postaları ve metin mesajlarında iyileştirmeler ve kimlik avı web sitelerinin oluşturulması

- Temel kodlama desteği – Çeşitli görevleri otomatikleştirmek için komut dosyalarının oluşturulması ve genel kötü amaçlı yazılımların sınırlı oluşturulması

Kaliteli GenAI araçlarını geliştirmek ve dağıtmak için giriş engelleri önemlidir ve bilgisayar korsanlarının teknolojiyi işlevsel hale getirmesinde caydırıcı olacaktır.

- OpenAI’nin ChatGPT’yi geliştirmek ve eğitmek için 500 milyon dolardan fazla harcadığı bildirildi.

- Ulus devlet tehditleri dışındaki bilgisayar korsanlığı gruplarının çok azı veya hiç yok, bu kaynakları ChatGPT kadar güvenilir olacak bir ölçekte araştırma ve geliştirmeye yatırım yapmak için hazır bulunduruyor.

Bu araçların ne işe yarayacağını anlamak da önemlidir. Olumsuz bugün yap:

- Saldırıların gerçekleşme biçiminde devrim yaratın: Mevcut GenAI araçlarına benzer şekilde, bunların işlevi mevcut bilgileri bir araya getirmektir. Mevcut veriler mevcut saldırılara ilişkindir ve bu da araçların yeni saldırı yolları hakkında daha yaratıcı düşünme yeteneğini sınırlamaktadır.

- Her insanı bir “süper hacker” yapın – Mevcut bilgiler, kolayca indirilebilen sızdırılmış taktik kitaplarında mevcuttur. Başka bir deyişle bu bilgiler herkesin erişimine açıktı ve benzer bir etki yaratmadı. Bilgiyi uygulamak için sistemlerin ve ağların nasıl çalıştığına dair mevcut düzeyde bilgi gereklidir.

Yakın Vadede Minimum Etki

Kötü amaçlı GenAI araçlarının gelişimi hızlı görünse de, bu araçların gelişimi yıllardır üzerinde çalışılıyor. En kayda değer acil etki, dezenformasyon kampanyalarını destekleyen sahte görseller, videolar ve metinler de dahil olmak üzere dezenformasyonun hızla oluşturulmasını ve yayılmasını desteklemek olacaktır.

Güncel yinelemelerle bile siber saldırılar üzerindeki etki araştırılırken, bunların benimsenmesinin siber saldırıları iyileştirme olasılığı öncelikle kimlik avı e-postaları, kısa mesajlar ve web siteleri gibi artan sosyal mühendislik etkinliği potansiyeli ile sınırlıdır.

Bu yeteneklerde artan gelişmeler beklemek doğru olsa da mevcut araştırmalar, insan tarafından oluşturulan kimlik avı e-postalarının, GenAI tarafından oluşturulan e-postalardan yüzde 45 daha iyi performans gösterdiğini gösteriyor. Bu muhtemelen zamanla değişecektir.

Yakın vadede kuruluşların siber saldırıları önleme konusunda nasıl düşünmesi gerektiği konusunda hemen bir değişiklik olmayacak. Peki ya yolun aşağısında?

Gelecek – Gerçek Risk Gerçekleşiyor

Gelecekteki Nesil Yapay Zeka yetenekleri, otomasyon yoluyla bilgisayar korsanları için daha iyi saldırı verimliliği sağlayacak. Gelişmiş araçları oluşturmak ve sürdürmek için gereken uzmanlık ve kaynaklara bağlı olarak, yetenekler zaman içinde (örneğin yıllar içinde) aşamalı olarak artacaktır.

GenAI’nin kötü amaçlarla uygulanmasına ve etkinliğine bakıldığında, başarı olasılığı araştırmayı finanse etme, araçları oluşturma ve araştırmayı eğitmek için gereken verilere erişim sağlama becerisinde yatmaktadır. Tarihte olduğu gibi, saldırganların araçları/teknolojiyi benimseme hızı, araçlarını açık kaynak olarak kullanan güvenlik araştırmacılarının araçları piyasaya sürmesini takip edecektir. Zamanla, finansal kazanca odaklanan ek bilgisayar korsanlığı grupları bu araçlara erişim sağlayacak. Güvenlik araştırmacıları GenAI’yi araçlarda test etmeye başladı ancak bugüne kadar çığır açan herhangi bir keşif veya kullanım örneği olmadı.

Kuruluşlar Riski Azaltmak İçin Ne Yapmalı?

GenAI, tehdit aktörlerine saldırı verimliliğini artırma konusunda bir adım öne çıkıyor ancak kısa vadede abartılı reklamlar ve yanlış bilgiler, kuruluşlar içinde gereksiz yere alarm zilleri çalıyor olabilir. Şirketlerin uygun risk azaltma stratejileriyle rotayı korumaları gerekiyor.

- Kimlikleri koruyun – Saldırılar, ortamlara erişim sağlamak için kullanıcı kimlik bilgilerini hedef alıyor. Erişim için Sıfır Güven ilkelerini uygularken kullanıcı kimliklerini geçiş anahtarları veya diğer FIDO2 teknolojileriyle güvence altına almak, saldırıların başlamadan önce durdurulmasına yardımcı olabilir.

- Uç noktaları koruyun – EDR teknolojileriyle uç noktaların izlenmesini ve güvenliğinin sağlanmasını sağlayın. Saldırılara hızlı bir şekilde yanıt vermek ve bunları kontrol altına almak için bunların ortamda tam olarak dağıtılması ve 7/24 izlenmesi gerekir.

- Dayanıklı ortamlar – Mevcut güvenlik kontrollerinin başarısız olduğunu varsayın ve ortamınızı bir saldırıya dayanabilecek şekilde oluşturun. Buna, bir saldırının patlama yarıçapını azaltan ve hızlı kurtarma sağlayan değişmez yedeklemeler ve ağ bölümlendirmesi de dahildir.

Yıllardır kuruluşlara uygulamaya teşvik ettiğimiz güvenlik savunmaları, tam ve doğru bir şekilde uygulandığında artık eskisi kadar etkili. Kötü adamlar GenAI odaklı “yeni hileleri” daha hızlı bulsalar bile, aynı savunmalar saldırı önlemede etkili olacaktır.

Reklam