Birleşik Krallık Ulusal Siber Güvenlik Merkezi (NCSC), yapay zeka (AI) araçlarının kısa vadede siber güvenlik üzerinde olumsuz bir etkiye sahip olacağı ve fidye yazılımı tehdidinin artmasına yardımcı olacağı konusunda uyarıyor.

Ajans, siber suçluların halihazırda yapay zekayı çeşitli amaçlar için kullandığını ve bu olgunun önümüzdeki iki yıl içinde daha da kötüleşerek siber saldırıların hacminin ve ciddiyetinin artmasına yardımcı olmasının beklendiğini söylüyor.

NCSC, AI’nın deneyimsiz tehdit aktörlerinin, kiralık bilgisayar korsanlarının ve düşük vasıflı hacktivistlerin, aksi takdirde önemli ölçüde zaman, teknik bilgi ve operasyonel çaba gerektirecek daha etkili, özel saldırılar gerçekleştirmelerini sağlayacağına inanıyor.

ChatGPT ve Bing Chat gibi mevcut büyük öğrenme modeli (LLM) platformlarının çoğu, platformun kötü amaçlı içerik oluşturmasını önleyen güvenlik önlemlerine sahiptir.

Ancak NCSC, siber suçluların suç faaliyetlerini desteklemek için özel olarak tasarlanmış özel üretken yapay zeka hizmetleri geliştirip pazarladıkları konusunda uyarıyor. Örnekler arasında, tehdit aktörlerinin kötü amaçlı yazılım ve kimlik avı tuzakları da dahil olmak üzere kötü amaçlı içerik oluşturmasına olanak tanıyan ücretli bir LLM hizmeti olan WormGPT yer alıyor.

Bu, teknolojinin halihazırda kontrollü, güvenli çerçevelerin sınırlarından kurtulduğunu ve daha geniş suç ekosisteminde erişilebilir hale geldiğini gösteriyor.

NCSC, ayrı bir tehdit değerlendirmesinde “Fidye yazılımı aktörleri de dahil olmak üzere tehdit aktörleri, siber operasyonların keşif, kimlik avı ve kodlama gibi yönlerinin verimliliğini ve etkinliğini artırmak için zaten yapay zekayı kullanıyor” uyarısında bulunuyor.

“Bu trendin 2025 ve sonrasında da devam edeceği neredeyse kesin.”

Raporda, yapay zekanın siber risk ortamındaki rolünün, dönüştürücü olmaktan ziyade mevcut tehditleri güçlendirecek şekilde evrimsel olmasının beklendiği belirtiliyor.

NCSC’nin değerlendirmesinin kilit noktaları şunlardır:

- Yapay zeka, özellikle mevcut taktiklerin geliştirilmesi yoluyla önümüzdeki iki yıl içinde siber saldırıları muhtemelen yoğunlaştıracak.

- Devlet ve devlet dışı kuruluşlar da dahil olmak üzere hem vasıflı hem de daha az vasıflı siber tehdit aktörleri şu anda yapay zekayı kullanıyor.

- Yapay zeka, keşif ve sosyal mühendisliği geliştirerek onları daha etkili ve tespit edilmesi zor hale getiriyor.

- Siber operasyonlarda gelişmiş yapay zeka kullanımı, 2025 yılına kadar esas olarak kaliteli verilere, uzmanlığa ve kaynaklara erişimi olan aktörlerle sınırlı kalacak.

- Yapay zeka, yapay zeka modellerinin daha hızlı, daha etkili veri analizine ve eğitimine olanak sağlayarak Birleşik Krallık’a yönelik siber saldırıları daha etkili hale getirecek.

- Yapay zeka, acemi siber suçluların giriş engellerini azaltarak küresel fidye yazılımı tehdidine katkıda bulunuyor.

- 2025 yılına gelindiğinde yapay zeka yeteneklerinin metalaştırılması, hem siber suçlular hem de devlet aktörleri için gelişmiş araçlara erişimi muhtemelen genişletecektir.

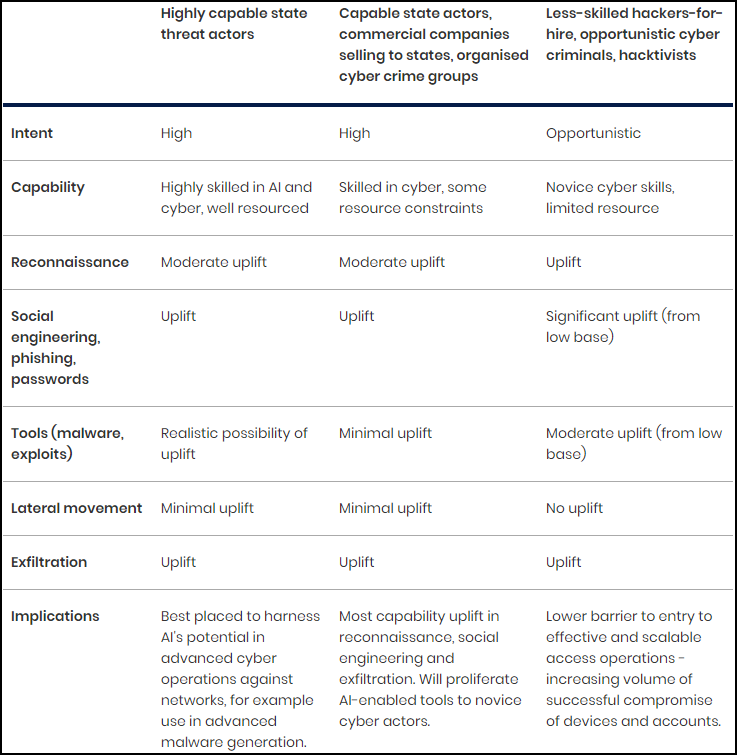

Aşağıdaki tablo, yapay zekanın üç beceri düzeyi için belirli tehdit alanları üzerinde sahip olması beklenen etkilerini özetlemektedir.

NCSC, gelişmiş APT’ler için yapay zekanın, kaçış amaçlı özel kötü amaçlı yazılımları daha kolay ve daha hızlı oluşturmalarına yardımcı olacağına inanıyor.

NCSC şöyle açıklıyor: “Yapay zeka, mevcut güvenlik filtreleri tarafından tespit edilmekten kaçabilecek kötü amaçlı yazılımlar üretme potansiyeline sahip, ancak yalnızca kaliteli istismar verileriyle eğitilmişse.”

“Son derece yetenekli devletlerin, bu amaç için bir yapay zeka modelini etkili bir şekilde eğitmeye yetecek kadar büyük kötü amaçlı yazılım depolarına sahip olmalarına dair gerçekçi bir olasılık var.”

Orta düzey bilgisayar korsanları öncelikli olarak keşif, sosyal mühendislik ve veri çıkarma konularında avantajlar elde ederken, daha az beceriye sahip tehdit aktörleri, zorlu olmaya devam eden yanal hareket dışında genel anlamda gelişmeler görecek.

Analizde “Yapay zekanın kötü amaçlı yazılımlara yardımcı olması ve mevcut teknikleri daha verimli hale getirerek geliştirmeyi, güvenlik açığı araştırmasını ve yanal hareketi istismar etmesi muhtemeldir” ifadesine yer veriliyor.

“Ancak yakın vadede bu alanlar insan uzmanlığına dayanmaya devam edecek, bu da sınırlı bir yükselişin büyük olasılıkla zaten yetenekli olan mevcut tehdit aktörleriyle sınırlı olacağı anlamına geliyor.”

Genel olarak NCSC, üretken yapay zeka ve büyük dil modellerinin, deneyim ve beceri düzeyi ne olursa olsun, kimlik avı, kimlik sahtekarlığı ve sosyal mühendislik girişimlerini tespit etmeyi herkes için oldukça zorlu hale getireceği konusunda uyarıyor.