YouTube CEO’su Neal Mohan, derin bir müjde kimlik avı dolandırıcılığında taklit edildi. Saldırı, kırmızı bayrakların nasıl tespit edileceği ve hesabınızı kimlik hırsızlığından nasıl koruyacağınız hakkında bilgi edinin.

Yapay zekadan yararlanan yeni bir sofistike kimlik avı operasyonu, yakın zamanda YouTube içerik yaratıcılarını hedef aldı. Dolandırıcılar, YouTube’un CEO’su Neal Mohan’ın ikna edici bir videosunu oluşturmak için DeepFake teknolojisini kullandı ve platformun para kazanma politikalarındaki değişiklikler hakkında uyumlu bir duyuru sundu.

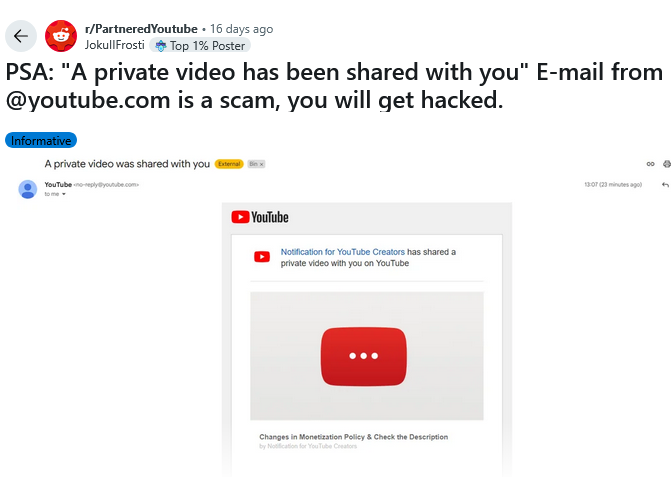

Bu video, giriş bilgilerini çalmak ve cihazlarına kötü amaçlı yazılım yüklemek için hedeflenen kullanıcılarla özel olarak paylaşılır. Hileli şema, görünüşte resmi bir YouTube adresinden kaynaklanan bir e -posta ile başlar ve içerik oluşturuculara özel bir videonun paylaşıldığını bildirir. Videonun kendisi, görünüşünü, sesini ve tavırlarını endişe verici bir dereceye kadar taklit eden, Neal Mohan’ın son derece gerçekçi bir derin püskürmesi var.

Videoda, AI tarafından üretilen Mohan, YouTube’un para kazanma iddialarını tartışarak izleyicileri belirli önlemler almaya çağırıyor. Bu eylemler genellikle bağlantılara tıklanmayı, sahte web sitelerinde oturum açma kimlik bilgileri girmeyi veya güvenilmeyen kaynaklardan yazılım indirmeyi içerir.

Bir kullanıcının hesabından ödün verdikten sonra, saldırganlar YouTube kanallarına erişir. Bu erişim daha sonra, yanlış bilgilendirme yayılması, daha fazla kimlik avı saldırısı yapmak veya hileli faaliyetlerde bulunma gibi çeşitli kötü niyetli amaçlar için kullanılabilir.

YouTube, bu tehdide yaratıcı topluluğuna acil bir uyarı ile yanıt verdi. Şirket, özel videolar aracılığıyla asla önemli bilgileri paylaşmayacağını veya kullanıcılarla iletişim kurmayacağını açıkça belirtti. Ayrıca, YouTube’dan geldiğini iddia eden herhangi bir özel videonun, özellikle CEO’suna sahip olanların kimlik avı dolandırıcılığı olarak ele alınması gerektiğini vurguladılar.

“YouTube’un CEO’su Neal Mohan’ın para kazanmada değişiklikler duyurduğu AI tarafından üretilen bir video da dahil olmak üzere, kimlikçilerin yanlış videolar göndermek için özel videolar paylaştıklarının farkındayız. YouTube ve çalışanları asla sizinle iletişim kurmaya veya özel bir video aracılığıyla bilgi paylaşmaya çalışmayacaklar ”dedi.

“YouTube’dan geldiğini iddia eden bir video sizinle özel olarak paylaşılıyorsa, video bir kimlik avı dolandırıcılığıdır. Videolar muhtemelen kötü amaçlı yazılım yükleyebilen veya kimlik bilgilerinizi çalabilen kimlik avı sitelerine yol açacağından, bu bağlantıları tıklamayın. ”

AI DeepFakes, gerçek görüntüler ve ses örnekleri üzerinde eğitilmiş ve insanların kamu figürlerine olan güvenini sömüren sofistike AI modelleri tarafından oluşturulan tehlikeli bir yanılsamadır. Teknoloji meraklı bireyler bile onları gerçek görüntülerden ayırmak için mücadele ederler. Bu olay, kimlik avı saldırılarının karmaşıklığının arttığını vurgulamaktadır, DeepFake teknolojisi YouTube CEO’su gibi yüksek profilli figürleri taklit etmek için kullanılmaktadır.

Siber suçlular, yaratıcıların resmi platform iletişimlerine olan güvenini kullanarak inandırıcı aldatmacalar yaratırlar. İçerik içerik oluşturucuları dikkatli olmaya ve güvenilmeyen kaynaklardan dosya indirmekten kaçınmaya teşvik edilir. Videoyu alırsanız Google, rapor etmek için bu adımları izlemenizi önerir.

COFENSE istihbarat yöneticisi Max Gannon, son geliştirme belirtisi hakkında yorum yaptı, “Deepforkes’ın tipik olarak sadece yüksek değerli hedeflenen dolandırıcılıklarda kullanıldığı göz önüne alındığında, tehdit aktörlerinin bunu bu kadar geniş bir saldırı için kullanması sürpriz. Daha büyük kitlelere geniş ölçüde uygulandığını daha fazla derin dişli ve diğer hedefli saldırı yöntemlerini görmeyi bekleyebileceğimiz tehdit ortamında bir değişim ile ilgili ve potansiyel olarak gösteriyor.“

“Bununla birlikte, çeşitli sosyal medya platformlarında bu sahte YouTube e -postaları yayınlayan etkilenen kullanıcılara göre, e -postalar oturum çerezlerini çalmak ve YouTube hesaplarını ele geçirmek için kötü niyetli yürütülebilir ürünler sunar. Nihayetinde, ilk kimlik avı kancası değişiyor olabilir, ancak en iyi savunma aynı kalır: şüpheli e -postaları tespit etmek ve bağlantılarını tıklamamak için eğitim ve farkındalık. ”

İlgili Konular

- YouTube kanalları sahte CS2 hediye aldatmaca

- Sahte iş tekliflerinde kötü amaçlı yazılım YouTube Creators

- Ukrayna Haber Kanalı, Zelensky’nin Deep Tepe’yi çalıştırmak için hacklendi

- Scam, sahte hukuk firmasını temsil etmek için AI tarafından oluşturulan görüntüler kullanır

- “Videoları beğenmek için para al” YouTube Scam boş cüzdanlara yol açar