Yapay Zeka ve Makine Öğrenimi, Yönetişim ve Risk Yönetimi, Yeni Nesil Teknolojiler ve Güvenli Gelişim

Dağınık araçlardan birleşik AI güvenlik stratejilerine geçme çerçevesi

Rajiv Bahl •

23 Mayıs 2025

Yapay zeka ile ilgili birden fazla konferansa katıldıktan sonra, CISOS’tan duyduğum tekrarlayan bir yanıt şudur: EDR, FWS, SIEM, SOAR, DLP, CASB, SASE ve diğer siber güvenlik çözümlerini anlıyoruz. Ancak yapay zeka amorf bir alan gibi görünüyor ve bu belirsiz varlığı ele almak bir meydan okuma olmaya devam ediyor. Yapay zeka için nokta güvenlik çözümleri ortaya çıkarken, kapsamlı bir çerçeve içinde zorlukları ele almak için yapılandırılmış bir yaklaşıma ihtiyaç vardır.

Ayrıca bakınız: Ondemand | Modern işletmeler kapsamlı kimlik güvenliği programları gerektirir: Kimlik güvenliğinde liderden en iyi uygulamalar

Bu topluluk talebine yanıt olarak, AI güvenlik endişelerini gidermek için sistematik bir yaklaşım geliştirmek için kilit yönleri incelemeye değer olacaktır.

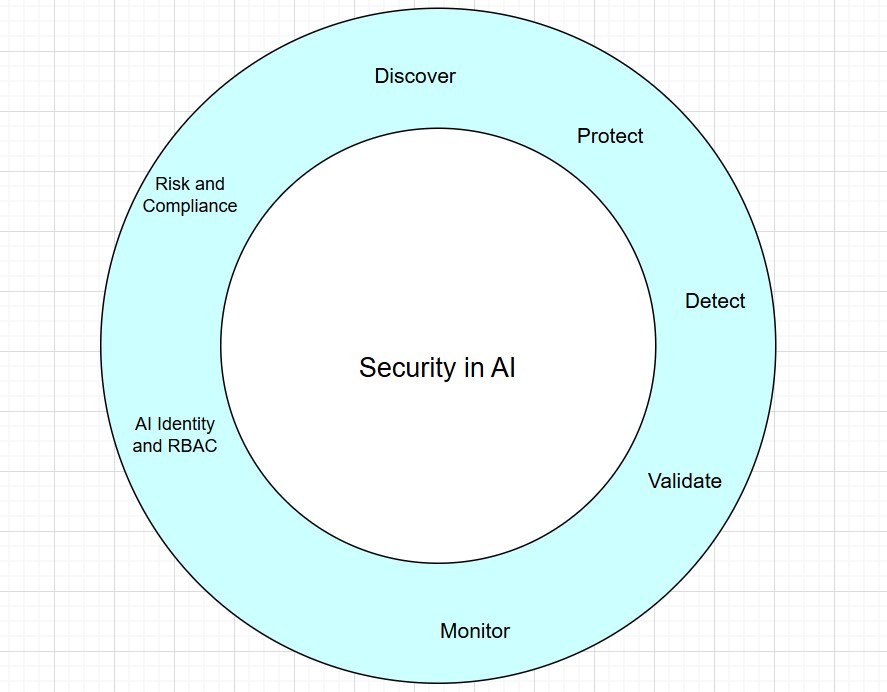

AI güvenliği yedi temel sütun civarında yapılandırılabilir:

Keşfetmek

Microsoft’un 2024 Kelime Trendi Dizin Yıllık Raporuna göre, bir kuruluştaki çalışanların% 75’i AI’yı bir şekilde veya formda kullanıyor – bu “Shadow AI” adlı bir kavram. Tarayıcı uzantıları gibi mevcut parçalanmış çözümler, tanınan sohbet botlarının kullanımını belirlemeye yardımcı olur. Ancak mevcut AI modellerinin çeşitliliği kapsamlı numaralandırmayı zorlu bir görev haline getiriyor. Basit bir yaklaşım, yetkisiz erişimi tespit etmek için çevre bağlantı noktalarını tanımlamak ve engellemek olacaktır. Bir sonraki savunma hattına geçiş gerektiren zorlu bir alan olarak sürekli keşfedin.

Korumak

Koruma iki yönlü bir strateji ile yaklaşılabilir:

- Giriş Filtrasyonu Hızlı enjeksiyon, indüklenen halüsinasyon veya eğitim veri zehirlenmesi gibi, gelen tüm AI girişlerini kötü niyetli niyet için filtreleyerek müşteri altyapısının korunmasını içerir. Giriş filtrelemesi, temel model korkulukları kullanılarak veya giriş korkulukları sağlayan ürünler satın alarak bir Blackbox çözümü olarak uygulanabilir. Geliştiriciler, bu korkulukları, temel modele özgü veya doğada agnostik olan birkaç mevcut çözüm aracılığıyla kod içinde ayarlayabilir.

- Çıkış filtrasyonu Veri sızıntısı önleme ve gizliliğin korunmasını birleştirmeyi içerir. Organizasyon IP, ticari sırlar, kişisel olarak tanımlanabilir bilgiler veya kişisel olarak tanımlanabilir davranış gibi hassas verilerin sızmasını sağlamayı amaçlamaktadır. AI’da AI DLP ve Gizlilik Kontrolünü etkinleştirmek için çeşitli ürünler mevcuttur. Yerli korkuluklar temel modeller için ayarlanabilir ve agnostik araçlar Aisecops iş akışına gömülebilir.

Kod jeneratörleri veya copilots ile IP sızıntısının izlenmesi de kritik öneme sahiptir ve şu anda platforma özgü birkaç çözüm mevcuttur.

Tespit etmek

AI modelleri, kod tabanları ve veri kümeleri, UEBA veya dosya bütünlüğü izleme çözümleri kullanılarak benzer şekilde izlenmelidir. Akıllı tespitler inşa edilebilir ve model kullanımındaki anomalileri tespit etmek için geleneksel SIEM platformuna beslenebilir. Hızlı enjeksiyon denemeleri, yetkisiz model erişimi, ayrıcalık artış girişimleri, gizli katman parametrelerini ve hassas veri kümesi eksfiltrasyon girişimlerine, kuruluşunuzun taç mücevherlerine benzer şekilde öncelik verilmelidir. Bu alanda, üçüncü taraf ürünlerle birlikte AI tehdit algılama ve yanıtı sunan ürünlere sahiptir.

Doğrulamak

Geleneksel kalem testi ve kırmızı takımın aksine, AI modelleri ve kodlar, sürekli doğrulama gerektiren sık değişikliklere uğrar. Geliştiriciler, model kayması nedeniyle kodlarında ve modellerinde değişiklikler yaptıkları için sürekli olarak doğrulamak için donanımlı olmalıdır. AI geliştirme yaşam döngüsünün benzersiz doğasını koruyan AI kırmızı takımını sağlayan çeşitli araçlar mevcuttur. Bu araçlar, tasarım yoluyla AI güvenliğini sağlamak için AisePOP’lara entegre edilmelidir.

İzlemek

AI’nın belirleyici olmayan doğası, zaman içinde model kaymasına yol açar ve topraklama, halüsinasyon ve zehirlenme girişimleri için sürekli izleme gerektirir. Bu, sürekli izleme çerçeveleri gerektirir. Modellerin önyargıları, nefreti veya küfürü halüsinasyon yapmamasını veya teşvik etmediğinden emin olmak için çözümler mevcuttur.

AI Kimliği ve RBAC

Ajan yapay zeka, özellikle çok ajan sistemlerinin ortaya çıkmasıyla, AI botları tarafından benimsenen kimlik ve rol kritik hale gelir. Bir AI ajanı, bir CXO’dan stajyere kadar değişen roller üstlenebilir ve erişim ayrıcalıklarını önemli ölçüde etkileyebilir. Yetkisiz erişimi önlemek için rol sağlama ve erişim kontrolü buna göre sağlanmalıdır. Çözme riski çok ajan bir ortamda hafifletilmelidir. Bu alanda yerleşik bir ürün yoktur, ancak bazı yaratıcılığa sahip mevcut teknolojiler kullanılarak kontroller kurulabilir.

Risk ve uyumluluk

Riski ve uyumluluğu desteklemek için çeşitli çerçeveler mevcuttur ve çerçevenin benimsenmesi, işletmenin yargı yetkisine ve müşterilerin konumuna bağlıdır. AB ve Birleşik Krallık için ISO/IEC 27001: 2022, ISO/IEC 42001: 2023 ve ISO/IEC 5338: 2023, süreç uyumluluğu için güçlü bir temel sağlar. Bu standartları OWASP Top 10 ve Mither Atlas ile hizalamak iyi bir yaklaşımdır.

ABD merkezli müşteriler NIST Risk Yönetimi Çerçevesi ile uyumlu olmalıdır. Gizlilik ve yapay zeka uyumluluğu arasındaki yakın ilişki göz önüne alındığında, AB için GDPR, Hindistan için DPDP Yasası, ABD devlet gizlilik yasaları ve ülkeye özgü diğer gizlilik yasaları gibi düzenlemelere uyum önemlidir.

NIST AI RMF’den yol gösterici bir ilke dikkat çekicidir: AI RMF “riske dayalı, kaynak açısından verimli, yanlısı ve gönüllü olmaya çalışır. Açıkçası, bir engel olarak hareket eden uyum yerine, yanlısı bir şekilde vurgulanmalıdır.

OWASP için AI Red takım pistine, OWASP AI Exchange’in yazarı olarak ve Kıdemli Başkan Yardımcısı, Baş Ürün Sorumlusu ve St. Fox’ta AI Labs başkanı olarak, çeşitli ürünleri değerlendirdim ve son RSA Konferansı’nda AI Security ile ilgili çeşitli oturumlara katıldım. AI güvenliği için birkaç nokta çözümünün mevcut olduğu açıktır, ancak yeni ürünler, büyük baskın oyuncu olmadan yeni ürünler çeşitli niş boyunca piyasaya sürüldüğünde şu anda parçalanmıştır. AI güvenlik piyasası hızla gelişiyor ve konsolidasyon yakın. Yerleşik bir lider ortaya çıkana kadar, AI güvenliğine yapılandırılmış bir yaklaşım benimsemek, organizasyonların mükemmel ve kapsamlı bir çözümü beklemek yerine güvenliği tasarımla yerleştirmelerini sağlayacaktır.