Google, eğitim sırasında hassas verileri özel tutmak için tasarlanmış büyük bir dil modeli olan Vaultgemma’yı yayınladı. Model, bireysel veri noktalarının maruz kalmasını önlemek için farklı gizlilik teknikleri kullanır, bu da sağlık, finans ve hükümet gibi sektörlerde gizli bilgileri ele almayı daha güvenli hale getirir.

Sürüm, Google’ın Gemma model ailesinin bir parçasıdır ve gizliliği koruyan AI sistemlerini denemek isteyen araştırmacılar ve geliştiricilere yöneliktir. Modeli açık kaynaklayarak Google, güvenli makine öğrenimi üzerinde çalışmayı hızlandırmayı ve gizlilik odaklı yaklaşımları test etmeyi ve dağıtmayı kolaylaştırmayı umuyor.

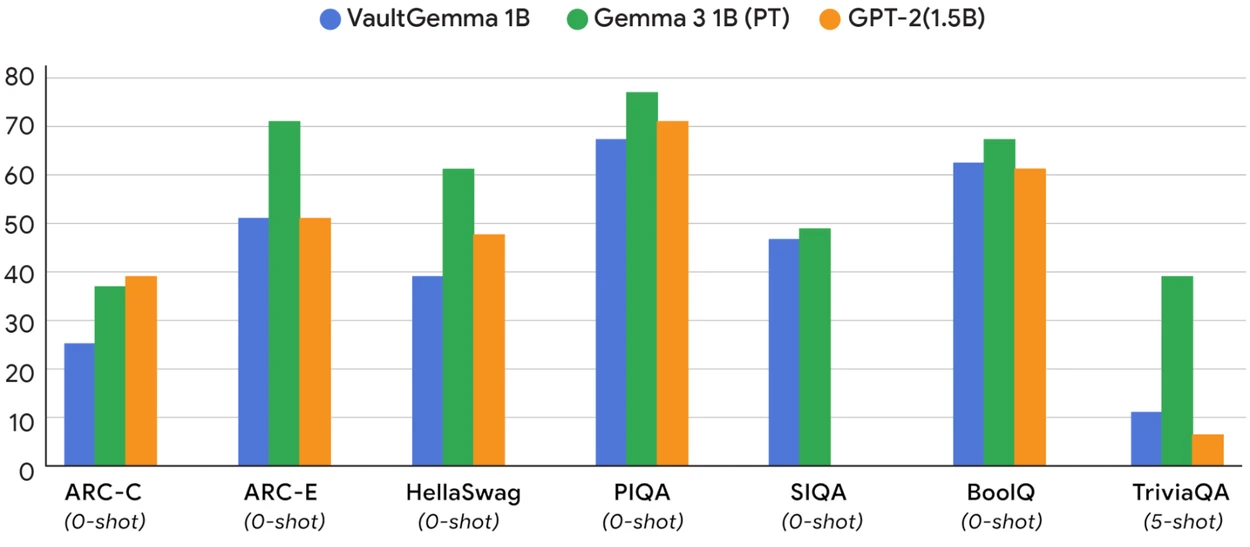

Vaultgemma 1B’nin (farklı şekilde özel) özel olmayan muadili (GEMMA3 1B) ve daha eski bir taban çizgisi (GPT-2 1.5B) ile performans karşılaştırması. Sonuçlar, gizlilik için gerekli olan mevcut kaynak yatırımını ölçmekte ve DP eğitiminin yaklaşık beş yıl önceki özel olmayan modellerle karşılaştırılabilir hizmet verdiğini göstermektedir. (Kaynak: Google)

Başlangıçtan itibaren gizliliğe odaklanma

Vaultgemma, herhangi bir kişi hakkında ne kadar bilgi bir modelden öğrenilebileceğini sınırlayan matematiksel bir yöntem olan diferansiyel gizlilikle eğitilmiştir. Google, modelin hassas veri kümeleri üzerinde güvenli bir şekilde eğitilebileceğini, çünkü eğitim sürecinde maruz kalan veri miktarını kontrol ettiğini söylüyor.

Ekip, açık veri kümeleri ve sentetik veriler kullanarak Vaultgemma’yı inşa etti. Amaç, eğitim verilerinden belirli ayrıntıları ezberlemeyen bir model oluşturmaktı. Bu, diğer büyük dil modellerinde görülen bir sorun olan model çıktıları yoluyla veri sızıntısı riskini azaltır.

Duyurusunda Google, Vaultgemma’nın harici gözden geçirenler tarafından bağımsız olarak doğrulanan farklı gizliliğin katı tanımlarını karşıladığını vurguladı. Bu, yalnızca gizliliği koruduğunu iddia eden, ancak resmi standartları karşılamayan modellerden farklı hale getirir.

Model nasıl inşa edildi

Vaultgemma, 1 milyar parametreli bir versiyonda geliyor, bu da büyük ticari modellerden daha küçük ve daha kolay test edilmesini sağlıyor. Google, araştırmacıların standart bulut kurulumları ve bazı yerel makineler de dahil olmak üzere daha mütevazı donanımlarda çalıştırabilmeleri için bu boyutu seçti.

Model, eğitim verilerine istatistiksel gürültü ekleyen bir işlem kullanılarak eğitildi. Bu gürültü, bireysel kayıtların yeniden inşa edilememesini veya tanımlanamamasını sağlar. Bu, modeli daha güvenli hale getirse de, doğru ayarlanmazsa eğitimi daha da zorlaştırabilir ve performansı azaltabilir.

Bunu ele almak için Google, özel optimizasyon teknikleri geliştirdi. Bu yaklaşımlar, gizlilik garantileri ile model doğruluğu arasındaki dengeyi korumaya yardımcı olur. Ekip, Vaultgemma’nın farklı gizlilikle eğitilmeyen benzer büyüklükteki modellere kıyasla kıyaslama görevleri üzerinde iyi performans gösterdiğini bildiriyor.

Geliştiriciler ve araştırmacılar için araçlar

Model ile birlikte Google, başkalarının farklı özel modelleri eğitmesine ve değerlendirmesine yardımcı olmak için kod ve belgeler yayınladı. Paket, değerlendirme komut dosyaları, gizlilik muhasebe araçları ve bir modelin farklı gizlilik standartlarını karşıladığını doğrulama talimatlarını içerir.

Google, hedefin topluluğa gizlilik odaklı AI sistemleri oluşturmak ve test etmek için güvenilir bir başlangıç noktası vermek olduğunu söylüyor. Araştırmacılar, model ağırlıklarından gizlilik araçlarına kadar tam yığın kullanılabilir hale getirerek, her şeyi sıfırdan inşa etmek zorunda kalmadan deneyebilirler.

Gizlilik ilk modelleri AI güvenliğini nasıl değiştirebilir?

Bunun gibi gizlilik koruyan modeller siber güvenlik ve uyumluluk çabalarında rol oynayabilir. Kuruluşlar genellikle yasal veya etik kaygılar nedeniyle AI modellerini eğitmek için kullanamayacakları hassas verilere sahiptir.

Güçlü gizlilik garantilerine sahip bir model, uygun kontrollerin mevcut olması koşuluyla, bu verilerin kullanılmasını daha güvenli hale getirebilir. Vaultgemma’nın kendisi üretim dağıtımları için değil olsa da, bu olasılıkları keşfetmek için bir test yatağı görevi görür.

Google, VaultGemma ve ilgili araçları geliştirmeye devam etmeyi planlıyor. Şirket bunu tasarım gereği güvenli olan AI sistemleri oluşturmak için daha büyük bir çabanın bir parçası olarak görüyor.