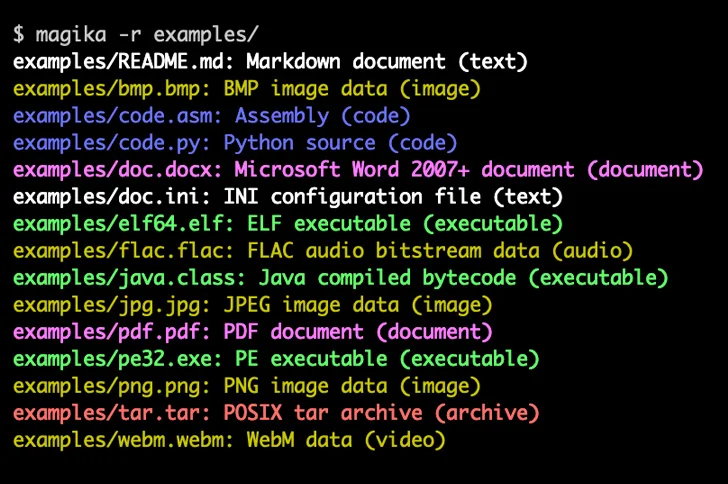

Google, savunucuların ikili ve metinsel dosya türlerini doğru bir şekilde tespit etmesine yardımcı olmak için dosya türlerini tanımlayan, yapay zeka (AI) destekli bir araç olan açık kaynaklı Magika’yı duyurdu.

Şirket, “Magika, VBA, JavaScript ve Powershell gibi geleneksel olarak tanımlanması zor ancak potansiyel olarak sorunlu içerik üzerinde genel olarak %30’luk bir doğruluk artışı ve %95’e kadar daha yüksek hassasiyet sağlayarak geleneksel dosya tanımlama yöntemlerinden daha iyi performans gösteriyor” dedi.

Yazılım, dosya türlerinin milisaniyeler içinde kesin olarak tanımlanmasını sağlayan “özel, yüksek düzeyde optimize edilmiş bir derin öğrenme modeli” kullanıyor. Magika, Açık Sinir Ağı Değişimini (ONNX) kullanarak çıkarım işlevlerini uygular.

Google, Gmail, Drive ve Güvenli Tarama dosyalarını uygun güvenlik ve içerik politikası tarayıcılarına yönlendirerek kullanıcıların güvenliğini artırmaya yardımcı olmak için dahili olarak Magika’yı geniş ölçekte kullandığını söyledi.

Kasım 2023’te teknoloji devi, Gmail’deki spam ve kötü amaçlı e-postalar gibi potansiyel olarak zararlı içerikleri tespit etmeye yönelik çok dilli bir metin işleme modeli olan RETVec’i (Resilient and Efficient Text Vectorizer’ın kısaltması) tanıttı.

Hızla gelişen teknolojinin riskleri ve bunun Rusya, Çin, İran ve Kuzey Kore ile ilişkili ulus devlet aktörleri tarafından bilgisayar korsanlığı çabalarını artırmak amacıyla kötüye kullanılması konusunda devam eden bir tartışmanın ortasında Google, yapay zekayı geniş ölçekte dağıtmanın dijital güvenliği güçlendirebileceğini ve “eğilebileceğini” söyledi. Saldırganlardan savunuculara kadar siber güvenlik dengesi.”

Ayrıca, saldırganların yenilik yapabileceği ancak savunucuların yapay zeka yönetim tercihleri nedeniyle kısıtlandığı bir gelecekten kaçınmak için yapay zeka kullanımı ve benimsenmesine yönelik dengeli bir düzenleyici yaklaşıma duyulan ihtiyacı da vurguladı.

Teknoloji devinden Phil Venables ve Royal Hansen, “Yapay zeka, güvenlik profesyonellerinin ve savunucularının tehdit tespitinde, kötü amaçlı yazılım analizinde, güvenlik açığı tespitinde, güvenlik açığı düzeltmesinde ve olaylara müdahalede çalışmalarını ölçeklendirmelerine olanak tanıyor.” dedi. “Yapay zeka, Savunmacının İkilemini altüst etmek ve siber uzayın ölçeklerini değiştirerek savunuculara saldırganlara karşı kesin bir avantaj sağlamak için en iyi fırsatı sunuyor.”

Üretken yapay zeka modellerinin kişisel verileri de içerebilecek web’den kazınmış verileri eğitim amacıyla kullanması konusunda da endişeler dile getirildi.

Birleşik Krallık Bilgi Komiserliği Ofisi (ICO) geçen ay “Modelinizin ne için kullanılacağını bilmiyorsanız, alt kullanımın veri korumasına ve insanların hak ve özgürlüklerine saygı göstereceğinden nasıl emin olabilirsiniz?” dedi.

Dahası, yeni araştırmalar, büyük dil modellerinin görünüşte zararsız olabilen ancak belirli kriterler karşılandığında veya özel talimatlar sağlandığında aldatıcı veya kötü niyetli davranışlarda bulunacak şekilde programlanabilecek “uyuyan aracılar” olarak işlev görebileceğini gösterdi.

Yapay zeka girişimi Anthropic’ten araştırmacılar, “Bu tür arka kapı davranışları, denetimli ince ayar, takviyeli öğrenme ve düşmanca eğitim (güvensiz davranışı ortaya çıkarmak ve ardından bunu ortadan kaldırmak için eğitim) dahil olmak üzere standart güvenlik eğitimi teknikleriyle ortadan kaldırılmayacak şekilde kalıcı hale getirilebilir” dedi. çalışmada.