GitHub, Visual Studio’da gerçek zamanlı kaynak kodu ve işlev önerileri oluşturan bir programlama asistanı olan Copilot’un yapay zeka modelini güncelledi ve artık daha güvenli ve daha güçlü olduğunu söylüyor.

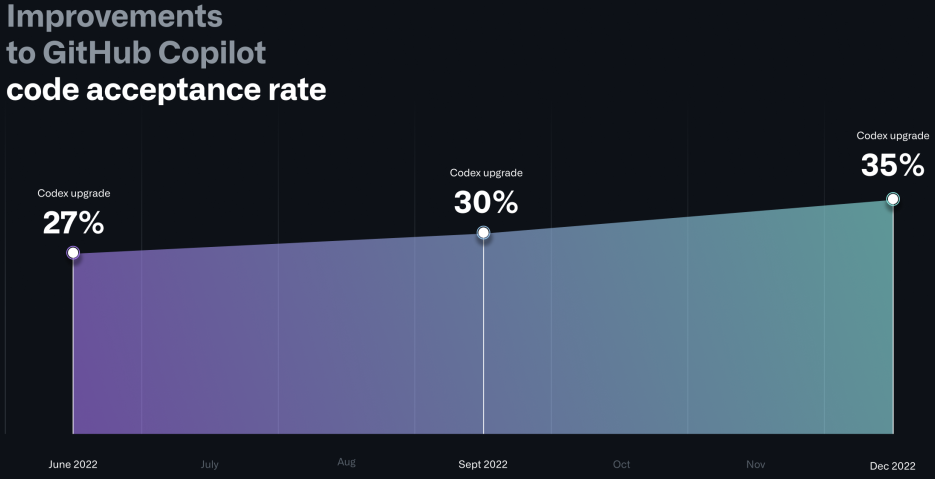

Şirket, bu hafta kullanıcıların hizmetine sunacağı yeni AI modelinin daha kısa sürede daha kaliteli öneriler sunduğunu ve kabul oranını artırarak kullanan yazılım geliştiricilerin verimliliğini daha da artırdığını söylüyor.

CoPilot, bilinen kod soneklerinden oluşan bir kitaplık kullanan ve yapay zeka aracının doldurması için bir boşluk bırakan, projenin kodunun geri kalanıyla daha iyi alaka düzeyi ve tutarlılık sağlayan “Ortada Doldur” adlı yeni bir paradigma sunacak.

Ayrıca GitHub, genel kod kabul oranlarını iyileştirmek için istenmeyen önerileri %4,5 oranında azaltmak üzere CoPilot istemcisini güncelledi.

Ürün Yönetimi Kıdemli Direktörü Shuyin Zhao, “Haziran 2022’de Bireyler için GitHub Copilot’u ilk kullanıma sunduğumuzda, geliştiricilerin kod dosyalarının ortalama %27’sinden fazlası GitHub Copilot tarafından oluşturuldu” dedi.

“Bugün GitHub Copilot, tüm programlama dillerinde bir geliştirici kodunun ortalama %46’sının arkasında ve Java’da bu sayı %61’e çıkıyor.”

Daha güvenli öneriler

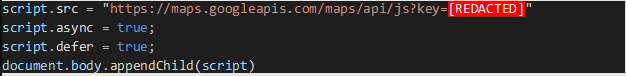

Bu CoPilot güncellemesindeki öne çıkan iyileştirmelerden biri, sabit kodlanmış kimlik bilgileri, yol enjeksiyonları ve SQL enjeksiyonları gibi güvenli olmayan önerileri belirlemeye ve engellemeye yardımcı olacak yeni bir güvenlik açığı filtreleme sisteminin kullanıma sunulmasıdır.

Zhao, “Yeni sistem, statik analiz araçlarının davranışına yaklaşmak için LLM’lerden (büyük dil modelleri) yararlanıyor ve GitHub Copilot, güçlü bilgi işlem kaynaklarında gelişmiş yapay zeka modelleri çalıştırdığından, inanılmaz derecede hızlı ve hatta tamamlanmamış kod parçalarındaki savunmasız kalıpları bile algılayabiliyor.” söz konusu.

“Bu, güvenli olmayan kodlama modellerinin hızla engellendiği ve alternatif önerilerle değiştirildiği anlamına gelir.”

Yazılım şirketi, CoPilot’un yeni dizilerdeki eğitim verilerinde görülen anahtarlar, kimlik bilgileri ve parolalar gibi sırlar üretebileceğini söylüyor. Ancak bunlar tamamen hayali oldukları ve yeni filtreleme sistemi tarafından engellenecekleri için kullanılamazlar.

Bu sırların CoPilot’un kod önerilerinde ortaya çıkması, yazılım geliştirme topluluğunun sert eleştirilerine neden oldu ve birçoğu Microsoft’u, yanlışlıkla sır içeren kümeler de dahil olmak üzere, yapay zeka modellerini güvenliğe pek aldırış etmeden eğitmek için halka açık büyük veri kümeleri kullanmakla suçladı.

GitHub, düzenleyicide güvenli olmayan önerileri gerçek zamanlı olarak engelleyerek, yapay zeka asistanlarını kötü amaçlı yükler içeren önerilerde bulunmaları için gizlice eğitmeyi amaçlayan zehirli veri kümesi saldırılarına karşı da bir miktar direnç sağlayabilir.

Şu anda, CoPilot’un LLM’leri, savunmasız ve savunmasız olmayan kod modellerini ayırt etmek için hâlâ eğitiliyor, bu nedenle AI modelinin bu cephedeki performansının yakın gelecekte kademeli olarak artması bekleniyor.