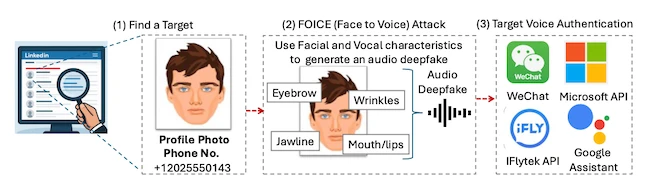

Bir saldırganın ikna edici bir sentetik ses oluşturmak için ihtiyaç duyduğu tek şey, birinin yüzünün fotoğrafı olabilir. Avustralya ulusal bilim ajansının yeni bir çalışması bu olasılığı araştırıyor ve deepfake dedektörlerinin fotoğraflardan konuşma üreten bir saldırı yöntemi olan FOICE’a (Yüzden Sese) karşı ne kadar iyi performans gösterdiğini test ediyor.

Yüz yüze deepfake çizimi

Yüzlerden seslere

Yeni bir teknik, sesli deepfake’lerin yapılma şeklini değiştiriyor. Metin veya ses örneği kullanmak yerine, bir kişinin yüzüne göre nasıl ses çıkarabileceğini tahmin ederek bir fotoğraftan konuşma üretebiliyor. Sistem, görünüm ile perde ve ton gibi ses özellikleri arasındaki bağlantıları öğreniyor ve ardından o seste konuşma üretiyor.

Fotoğrafları çevrimiçi olarak bulmak ses kayıtlarından çok daha kolay olduğundan, bu yaklaşım kimliğe bürünmenin ölçeklendirilmesini kolaylaştırır. Testlerde, hesap kimlik doğrulaması için kullanılan ses tabanlı bir oturum açma özelliği olan WeChat Voiceprint’i ilk denemede yaklaşık yüzde 30 ve birkaç denemeden sonra neredeyse yüzde 100 oranında kandırdı.

Oluşturulan ses, deepfake tespit modellerinin yakalamak üzere eğitildiği kalıplardan yoksun olduğundan, bu sistemlerin çoğu, sesin sahte olduğunu fark edemedi.

Akım dedektörlerinin test edilmesi

Dedektör performansını ölçmek için araştırmacılar gerçek ve sentetik konuşmalardan oluşan bir veri seti oluşturdular ve her sistemi üç dinleme koşulu altında test ettiler: temiz, gürültülü ve gürültüsüz ses. Dedektörlerin tanıdık ve alışılmadık yöntemleri nasıl ele aldığını görmek için hem FOICE tarafından oluşturulan hem de metinden konuşmaya örnekler içeriyordu.

Her biri ilk önce bir temel oluşturmak için orijinal durumunda test edildi, ardından FOICE tarafından oluşturulan örnekler kullanılarak yeniden eğitildi. Bu, hedeflenen ince ayarın performansı nasıl etkilediğini ve diğer sahte türlerde doğrulukta düşüşe neden olup olmadığını gösterdi.

Gerçek ve sentetik sesler arasında dengelenen binlerce örnek, telefon görüşmeleri ve çevrimiçi toplantılar gibi pratik durumları taklit etmek için kullanıldı.

Dedektörler yeni AI sesli saldırılarıyla karşılaştı

Araştırmacılar, FOICE ile oluşturulan sesi nasıl işlediklerini görmek için birçok popüler ses deepfake dedektörünü test etti. Önce her sistemin kendi başına nasıl performans gösterdiğini ölçtüler, ardından bunun yardımcı olup olmadığını görmek için onları FOICE tarafından oluşturulan ses örnekleriyle yeniden eğittiler.

Başlangıçta tüm dedektörler zorlandı. Geleneksel metin-konuşma veya ses dönüştürme deepfake’lerinde iyi çalışan sistemler, fotoğraflardan yapılan sesleri tanıyamadı. Bazıları gerçek kayıtları sahte olarak işaretlerken, diğerleri sahte kayıtların çoğunu gözden kaçırdı. Sorun şu ki, bu araçlar eski sentez yöntemlerinin bıraktığı izleri tespit etmek için tasarlandı ve FOICE aynı kalıpları yaratmıyor.

FOICE örnekleriyle yeniden eğitildikten sonra doğruluk arttı. Birkaç model bu sahte ürünlerde neredeyse mükemmel performans gösterdi. Ancak aynı dedektörler başka bir sentez yöntemiyle test edildiğinde performansları tekrar düştü. Bir model neredeyse yüzde 40’lık doğruluktan yüzde 4’ün altına düştü. Her iki testte de yalnızca bir sistem tutarlı kaldı.

Sonuçlar bir değiş tokuşu gösteriyor. Dedektörleri bir tür sahtekarlığı yakalayacak şekilde eğitmek, diğerlerini yakalama konusunda daha kötü olmalarına neden olabilir. İnce ayar, hızlı adaptasyon için işe yarar ancak aşırı uyum riski taşır; bu da yeni deepfake araçları ortaya çıktığında sistemleri çok dar ve daha az esnek hale getirebilir.

Değerlendirme kapsamı ve sınırlamaları

Yazarlar, testlerinin olası her saldırı senaryosunu kapsamadığını, ancak eğilimlerin ses kimlik doğrulaması ve tespitinde daha geniş bir soruna işaret ettiğini vurguladı. Sektörün daha geniş veri kümelerine, yeni eğitim rejimlerine ve geleneksel olmayan girdilerden üretilen sentetik sesleri tanımlayabilen modellere ihtiyacı olduğu sonucuna vardılar.

Ayrıca birden fazla jeneratör ve gerçek dünya ortamında genişletilmiş test yapılması çağrısında bulundular. Gelecekteki çalışmalar, dedektörlerin farklı ses kodlayıcılar, cihaz koşulları ve video tabanlı koşullandırma ile nasıl performans gösterdiğini araştırmalıdır. Hedefin reaktif ince ayarın ötesine geçmek ve yeni sentez modellerini doğada ortaya çıkmadan önce tanıyabilen proaktif savunmalara doğru ilerlemek olduğunu söylediler.