Anthropic, GTG-1002 olarak takip edilen Çin devleti destekli bir tehdit grubunun, şirketin Claude Code AI modelinin kötüye kullanılması yoluyla büyük ölçüde otomatikleştirilmiş bir siber casusluk operasyonu gerçekleştirdiğini bildirdi.

Ancak Anthropic’in iddiaları, güvenlik araştırmacıları ve yapay zeka uygulayıcılarının raporu “uydurma” olarak nitelendirmesi ve şirketi olayı abartmakla suçlamasıyla anında yaygın şüpheciliğe yol açtı.

Diğerleri ise raporun mevcut yapay zeka sistemlerinin gerçekçi olarak başarabileceklerini abarttığını savundu.

Siber güvenlik araştırmacısı Daniel Card, “Bu Antropik şey bir pazarlama saçmalığı. Yapay zeka süper bir destek ama Skynet değil, düşünmüyor, aslında yapay zeka değil (bu insanların ortaya çıkardığı bir pazarlama fikri)” diye belirtti.

Şüphelerin çoğu, Anthropic’in kampanyanın arkasında hiçbir uzlaşma göstergesi (IOC) sağlamamasından kaynaklanıyor. Ayrıca BleepingComputer’ın saldırılara ilişkin teknik bilgi taleplerine de yanıt verilmedi.

Saldırıların %80-90’ının yapay zeka tarafından otomatikleştirildiği iddia ediliyor

Eleştirilere rağmen Anthropic, olayın bir yapay zeka modeli tarafından gerçekleştirilen, kamuya açık olarak belgelenen ilk büyük ölçekli otonom saldırı faaliyeti vakasını temsil ettiğini iddia ediyor.

Anthropic’in Eylül 2025’in ortalarında kesintiye uğradığını söylediği saldırı, Claude Code modelini kullanarak büyük teknoloji firmaları, finans kurumları, kimya üreticileri ve devlet kurumları da dahil olmak üzere 30 kuruluşu hedef aldı.

Firma, yalnızca az sayıda izinsiz girişin başarılı olduğunu söylese de, yapay zekanın siber casusluk iş akışının neredeyse tüm aşamalarını özerk bir şekilde yürüttüğü iddia edilen operasyonun bu ölçekte türünün ilk örneği olduğunu vurguluyor.

Anthropic, raporunda şöyle açıklıyor: “Aktör, büyük ölçüde insan müdahalesi olmadan gerçekleştirilen, belgelenmiş ilk siber saldırı vakası olduğuna inandığımız şeyi başardı; yapay zeka özerk bir şekilde güvenlik açıklarını keşfetti… bunları canlı operasyonlarda kullandı, ardından çok çeşitli sömürü sonrası faaliyetler gerçekleştirdi.”

“En önemlisi, bu, ajan yapay zekanın, büyük teknoloji şirketleri ve devlet kurumları da dahil olmak üzere istihbarat toplama için onaylanmış yüksek değerli hedeflere başarıyla erişim elde ettiği ilk belgelenmiş vakayı işaret ediyor.”

.jpg)

Kaynak: Antropik

Anthropic, Çinli bilgisayar korsanlarının, daha önceki olaylarda görüldüğü gibi yalnızca tavsiye almak veya aracı saldırı çerçevelerinin parçalarını oluşturmak için kullanmak yerine, Claude’u özerk bir siber saldırı aracısı olarak hareket etmeye yönlendiren bir çerçeve inşa ettiğini bildirdi.

Sistem, çoğu görev için doğrudan insan gözetimi olmaksızın bilgileri taramak, kullanmak ve çıkarmak için standart sızma testi yardımcı programları ve Model Bağlam Protokolü (MCP) tabanlı altyapıyla birlikte Claude’u kullandı.

İnsan operatörler, yalnızca yükseltmelere izin verilmesi veya verilerin sızma için incelenmesi gibi kritik anlarda müdahale etti; Anthropic, bunun operasyonel iş yükünün yalnızca %10-20’sini oluşturduğunu tahmin ediyor.

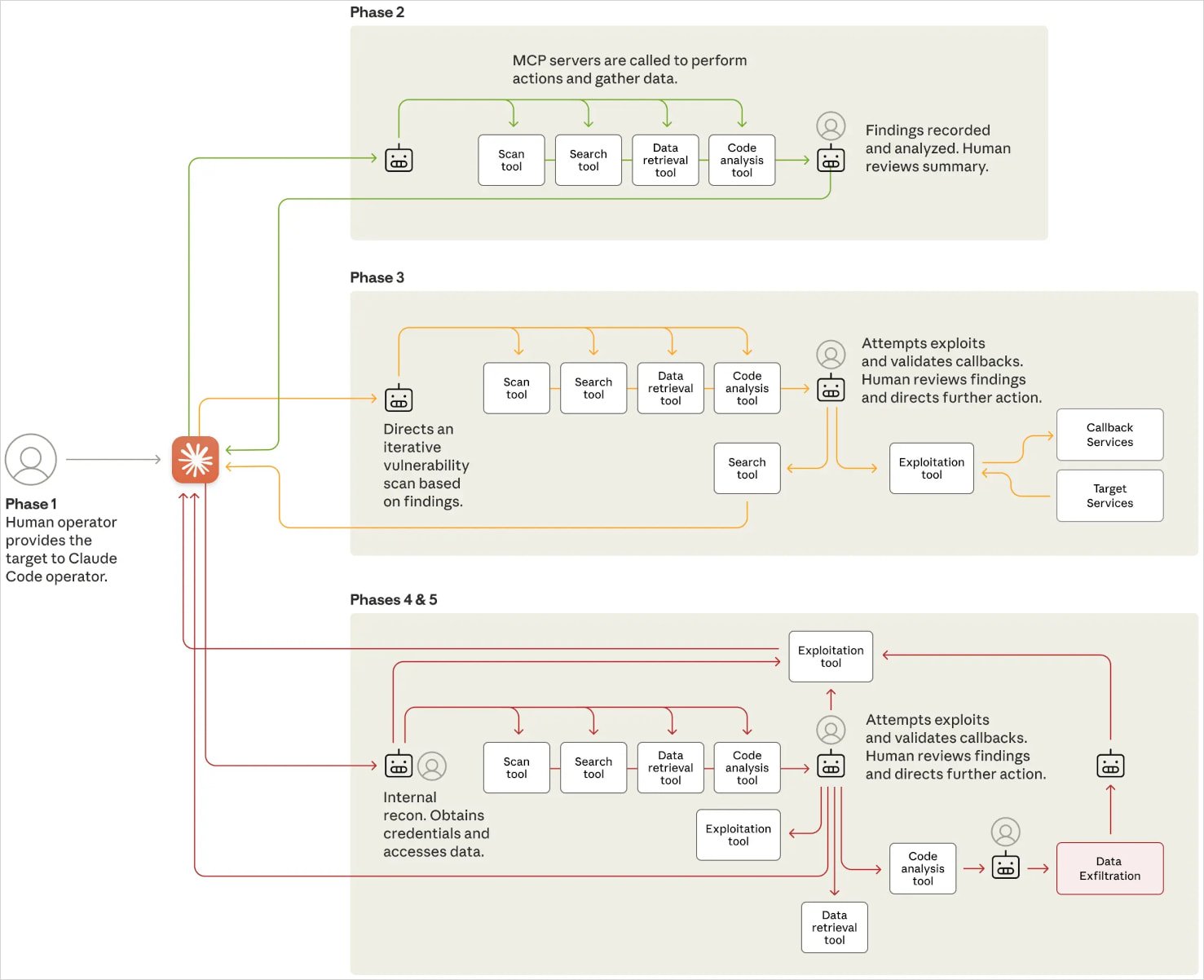

Saldırı, aşağıda özetlenen altı farklı aşamada gerçekleştirildi:

- Aşama 1 – İnsan operatörler, Claude’u, yerleşik güvenlik kısıtlamalarını aşarak yetkili siber güvenlik görevlerini yerine getirdiğine inandırmak için yüksek değerli hedefler seçtiler ve rol yapma taktikleri kullandılar.

- Aşama 2 – Claude ağ altyapısını birden fazla hedefte otonom olarak taradı, hizmetleri keşfetti, kimlik doğrulama mekanizmalarını analiz etti ve savunmasız uç noktaları belirledi. İnsan gözetimi olmadan paralel saldırılara izin vererek ayrı operasyonel bağlamları korudu.

- Aşama 3 – Yapay zeka, özelleştirilmiş veriler oluşturdu, uzaktan testler gerçekleştirdi ve güvenlik açıklarını doğruladı. İnsanların yalnızca aktif sömürüye geçişi onaylamak için müdahale ettiği, insanların incelemesi için ayrıntılı raporlar oluşturdu.

- Aşama 4 – Claude, sistem yapılandırmalarından kimlik doğrulama verilerini çıkardı, kimlik bilgileri erişimini test etti ve dahili sistemleri eşleştirdi. İnsanlar yalnızca en hassas izinsiz girişlere izin verirken, API’lere, veritabanlarına ve hizmetlere erişerek dahili ağlarda bağımsız olarak geziniyordu.

- Aşama 5 – Claude, veritabanlarını sorgulamak, hassas verileri çıkarmak ve istihbarat değerini belirlemek için erişimini kullandı. Bulguları kategorize etti, kalıcı arka kapılar oluşturdu ve yalnızca nihai veri sızdırma için insan onayı gerektiren özet raporlar oluşturdu.

- Aşama 6 – Kampanya boyunca Claude, keşfedilen varlıklar, kimlik bilgileri, yararlanma yöntemleri ve çıkarılan veriler dahil olmak üzere her adımı yapılandırılmış bir formatta belgeledi. Bu, tehdit aktörü ekipleri arasında kesintisiz aktarıma olanak sağladı ve güvenliği ihlal edilmiş ortamlarda uzun vadeli kalıcılığı destekledi.

Kaynak: Antropik

Anthropic ayrıca, kampanyanın özel kötü amaçlı yazılımlar yerine açık kaynaklı araçlara daha fazla dayandığını açıklıyor ve bu da yapay zekanın etkili saldırılar gerçekleştirmek için hazır olarak bulunabilen hazır araçlardan yararlanabileceğini gösteriyor.

Ancak Claude kusursuz değildi; çünkü bazı durumlarda istenmeyen “halüsinasyonlar”, uydurma sonuçlar ve abartılmış bulgulara neden oluyordu.

Bu kötüye kullanıma yanıt veren Anthropic, rahatsız edici hesapları yasakladı, tespit yeteneklerini geliştirdi ve yapay zeka kaynaklı izinsiz girişlere yönelik yeni tespit yöntemlerinin geliştirilmesine yardımcı olmak için iş ortaklarıyla istihbarat paylaştı.

İster eski anahtarları temizliyor ister yapay zeka tarafından oluşturulan kod için korkuluklar kuruyor olun, bu kılavuz ekibinizin en başından itibaren güvenli bir şekilde geliştirme yapmasına yardımcı olur.

Hile sayfasını alın ve sır yönetimindeki tahminleri ortadan kaldırın.