Veracode’s’a göre, Genai fonksiyonel kod üretmede mükemmel olsa da, vakaların yüzde 45’inde güvenlik açıkları getiriyor. 2025 Genai Kod Güvenlik Raporu80 gerçek dünya kodlama görevinde 100 LLMS tarafından üretilen kodu analiz eden.

Vibe kodlama

Veracode CTO’dan Jens Wessling, “Geliştiricilerin, genellikle güvenlik gereksinimlerini açıkça tanımlamadan kod oluşturmak için AI’ya güvendiği vibe kodlamasının yükselişi, yazılımın oluşturulma şeklinde temel bir değişimi temsil ediyor” dedi. “Bu eğilimin temel endişesi, istedikleri kodu almak için güvenlik kısıtlamalarını belirtmeleri gerekmediği, güvenli kodlama kararlarını LLM’lere etkili bir şekilde bırakmasıdır.

AI, saldırganların güvenlik açıklarını daha hızlı tanımlamasını ve kullanmasını sağlıyor. AI tarafından desteklenen araçlar sistemleri ölçeklendirebilir, zayıflıkları tanımlayabilir ve hatta minimal insan girişi ile istismar kodu oluşturabilir. Bu, daha az vasıflı saldırganlar için giriş engelini düşürür ve saldırıların hızını ve karmaşıklığını arttırır ve geleneksel güvenlik savunmaları için bir tehdit oluşturur. Güvenlik açıkları sadece artmakla kalmaz, aynı zamanda onları kullanma yeteneği de kolaylaşır.

LLMS, kodda yaygın güvenlik açıkları sunar

AI tarafından oluşturulan kodun güvenliğini değerlendirmek için Veracode, Gönderi Yaygın Zayıflık Numarnation (CWE) sistemi tarafından tanımlanan ortak yazılım zayıflıklarını ortaya çıkarmak için tasarlanmış 80 kodlama görevi oluşturdu. Her görev, 100 LLM’den fazla kod snippet’lerini tamamlamaya teşvik ederek güvenli veya güvensiz bir uygulama seçme fırsatı sundu.

Bulgular açıktı: Tüm test vakalarının yüzde 45’inde, LLM’ler, en ciddi web uygulaması güvenlik risklerinin bir listesi olan OWASP Top 10 ile uyumlu güvenlik açıkları içeren kod üretti.

Bazı diller özellikle sorunlu oldu. Java, en yüksek arıza oranına sahipti, LLM tarafından üretilen kodun yüzde 70’inden fazlası güvenlik kusurları getirdi. Python, C# ve JavaScript çok geride değildi, başarısızlık oranları yüzde 38 ila 45 arasında.

LLMS ayrıca belirli güvenlik açığı türleriyle de mücadele etti. Kod örneklerinin yüzde seksen altısı, siteler arası komut dosyasına (CWE-80) karşı savunamadı ve yüzde 88’i enjeksiyon saldırılarına (CWE-117) karşı savunmasızdı.

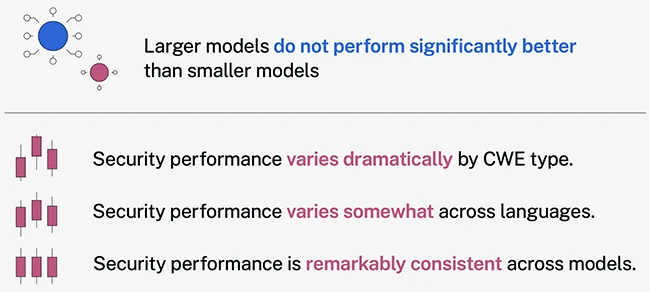

Wessling, “Araştırmalarımız, modellerin doğru bir şekilde kodlamada daha iyi hale geldiğini, ancak güvenlikte gelişmediğini gösteriyor. Ayrıca, daha büyük modellerin daha küçük modellerden önemli ölçüde daha iyi performans göstermediğini, bunun bir LLM ölçeklendirme probleminden ziyade sistemik bir sorun olduğunu gösterdiğini bulduk” dedi.

AI güdümlü yazılım boru hattını güvence altına almak

Vibe kodlaması gibi genai geliştirme uygulamaları üretkenliği hızlandırırken, riskleri de artırırlar. Araştırmacılar, kuruluşların üretime ulaşmadan önce güvenlik açıklarını önleyen bir risk yönetimi programına ihtiyaç duyduklarını vurgulamaktadır – kod kalitesi kontrollerini ve otomatik düzeltmeleri doğrudan geliştirme iş akışına entegre eder.

Kuruluşlar AI destekli gelişimi giderek daha fazla kullandıkça, Veracode güvenliği sağlamak için aşağıdaki proaktif önlemleri almanızı önerir:

- Güvenlik risklerini gerçek zamanlı olarak düzeltmek için AI ile çalışan araçları geliştirici iş akışlarına entegre edin.

- Kusurları erken ve otomatik olarak tespit etmek için statik analizden yararlanarak, savunmasız kodun geliştirme boru hatları yoluyla ilerlemesini önleyin.

- Politika uyumluluğunu otomatikleştirmek ve AI ajanlarının güvenli kodlama standartlarını uygulamak için aracı iş akışlarında güvenliği yerleştirin.

- Yapay zeka tarafından üretilen kodun üçüncü taraf bağımlılıklardan ve açık kaynaklı bileşenlerden güvenlik açıkları getirmemesini sağlamak için Yazılım Kompozisyon Analizini (SCA) kullanın.

- Geliştiricileri düzeltme talimatlarını güçlendirmek ve önerileri kullanmaları için eğitmek için AI odaklı iyileştirme rehberliği benimseyin.

- Kötü amaçlı paketleri, güvenlik açıklarını ve politika ihlallerini otomatik olarak algılamak ve engellemek için bir güvenlik duvarı dağıtın.